กม. AI ฉบับแรกจ่อคลอด! สแกนหน้า-ข้อมูลส่วนตัวจะเปลี่ยนไป

- ภาพรวมของกฎหมาย AI ฉบับแรกของไทย

- หลักการสำคัญ: การจัดกลุ่ม AI ตามระดับความเสี่ยง

- ผลกระทบต่อการคุ้มครองข้อมูลส่วนบุคคลและเทคโนโลยีสแกนใบหน้า

- กลไกการกำกับดูแล: ศูนย์ AIGPC และ Monitoring Dashboard

- ขั้นตอนและกรอบเวลาสู่การบังคับใช้

- ทิศทางของไทยบนเวทีจริยธรรมดิจิทัลระดับโลก

- บทสรุป: เตรียมพร้อมรับความเปลี่ยนแปลง

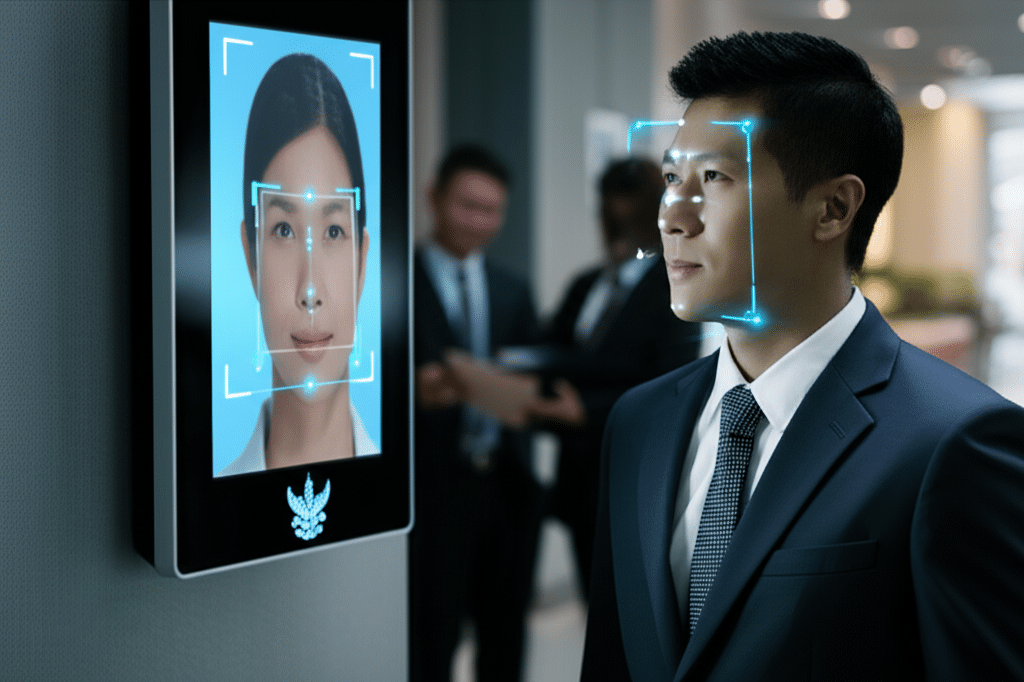

ภูมิทัศน์ทางเทคโนโลยีของประเทศไทยกำลังจะเกิดการเปลี่ยนแปลงครั้งสำคัญ เมื่อร่างกฎหมายควบคุมปัญญาประดิษฐ์ (AI) ฉบับแรกของประเทศใกล้ความจริงเข้ามาทุกขณะ การมาถึงของกฎหมายนี้ส่งสัญญาณถึงยุคใหม่ของการกำกับดูแลเทคโนโลยี โดยเฉพาะอย่างยิ่งในประเด็นที่เกี่ยวข้องกับการใช้ข้อมูลส่วนบุคคลและเทคโนโลยีชีวมิติ เช่น การสแกนใบหน้า

ภาพรวมของกฎหมาย AI ฉบับแรกของไทย

เมื่อ กม. AI ฉบับแรกจ่อคลอด! สแกนหน้า-ข้อมูลส่วนตัวจะเปลี่ยนไป นั้นหมายถึงการเปลี่ยนแปลงที่มีนัยสำคัญต่อการพัฒนาและใช้งานปัญญาประดิษฐ์ในประเทศไทย ร่างกฎหมายฉบับนี้ ซึ่งขับเคลื่อนโดยกระทรวงดิจิทัลเพื่อเศรษฐกิจและสังคม (ดีอี) มีเป้าหมายเพื่อสร้างกรอบการกำกับดูแลที่ชัดเจน เพื่อให้การนำ AI มาใช้เป็นไปอย่างปลอดภัย มีจริยธรรม และเคารพต่อสิทธิขั้นพื้นฐานของประชาชน โดยคาดว่าจะมีการประกาศใช้อย่างเป็นทางการภายในปี 2568-2569

ความสำคัญของกฎหมายนี้ไม่ได้อยู่ที่การจำกัดหรือขัดขวางนวัตกรรม แต่เป็นการสร้างสมดุลระหว่างการส่งเสริมการพัฒนาเทคโนโลยีใหม่กับการคุ้มครองสิทธิส่วนบุคคล ซึ่งเป็นหัวใจสำคัญของการเปลี่ยนผ่านสู่ยุคดิจิทัลอย่างยั่งยืน กฎหมายนี้จะเข้ามามีบทบาทในการกำหนดมาตรฐานสำหรับผู้พัฒนาและผู้ให้บริการ AI เพื่อให้มั่นใจว่าเทคโนโลยีที่ถูกนำมาใช้ในสังคมไทยนั้นมีความโปร่งใส ตรวจสอบได้ และไม่สร้างผลกระทบเชิงลบต่อสิทธิเสรีภาพของประชาชน การเปลี่ยนแปลงนี้จะส่งผลโดยตรงต่อธุรกิจที่ใช้ AI ในการวิเคราะห์ข้อมูลลูกค้า การให้บริการ หรือแม้กระทั่งการรักษาความปลอดภัย รวมถึงหน่วยงานภาครัฐที่นำ AI มาใช้ในบริการสาธารณะต่างๆ

กฎหมาย AI ฉบับนี้ถูกออกแบบมาเพื่อส่งเสริมนวัตกรรมควบคู่ไปกับการคุ้มครองสิทธิขั้นพื้นฐานของประชาชน สร้างมาตรฐานใหม่สำหรับการใช้เทคโนโลยีปัญญาประดิษฐ์อย่างมีจริยธรรมและยั่งยืน

การเตรียมความพร้อมเพื่อรับมือกับกฎหมายใหม่จึงเป็นสิ่งจำเป็นสำหรับทุกภาคส่วน ไม่ว่าจะเป็นผู้ประกอบการ นักพัฒนา หรือประชาชนทั่วไป การทำความเข้าใจในหลักการและข้อกำหนดของกฎหมายจะช่วยให้สามารถปรับตัวและใช้ประโยชน์จากเทคโนโลยีปัญญาประดิษฐ์ได้อย่างเต็มศักยภาพภายใต้กรอบกติกาใหม่ที่กำลังจะเกิดขึ้น ซึ่งจะนำไปสู่ระบบนิเวศ AI ที่น่าเชื่อถือและเป็นประโยชน์ต่อสังคมโดยรวม

หลักการสำคัญ: การจัดกลุ่ม AI ตามระดับความเสี่ยง

หัวใจของร่างกฎหมาย AI ฉบับนี้คือการใช้แนวทางกำกับดูแลตามระดับความเสี่ยง (Risk-Based Approach) ซึ่งเป็นการจำแนกประเภทของระบบปัญญาประดิษฐ์ตามศักยภาพในการสร้างผลกระทบต่อสิทธิและความปลอดภัยของประชาชน แนวทางนี้ช่วยให้การกำกับดูแลมีความยืดหยุ่นและเหมาะสมกับบริบทการใช้งานที่แตกต่างกัน โดยไม่ได้ใช้มาตรการเดียวกันกับ AI ทุกประเภท แต่จะมุ่งเน้นการควบคุมเฉพาะส่วนที่มีความเสี่ยงสูงอย่างเข้มงวด ขณะที่เปิดโอกาสให้ AI ความเสี่ยงต่ำสามารถพัฒนาได้อย่างอิสระมากขึ้น โดยสามารถแบ่งกลุ่ม AI หลักๆ ได้ดังนี้

กลุ่มความเสี่ยงต้องห้าม (Prohibited AI)

กลุ่มนี้หมายถึงระบบปัญญาประดิษฐ์ที่ถูกพิจารณาว่ามีอันตรายต่อสิทธิขั้นพื้นฐานและค่านิยมของสังคมอย่างร้ายแรงจนไม่อาจยอมรับได้ กฎหมายจะกำหนดห้ามการพัฒนาและใช้งาน AI ในกลุ่มนี้โดยเด็ดขาด ตัวอย่างของ AI ที่อาจเข้าข่ายกลุ่มนี้ เช่น ระบบที่ใช้ในการให้คะแนนทางสังคม (Social Scoring) โดยภาครัฐที่นำไปสู่การเลือกปฏิบัติ, ระบบที่อาจชักจูงพฤติกรรมของบุคคลในลักษณะที่เป็นอันตรายโดยที่บุคคลนั้นไม่รู้ตัว (Subliminal Manipulation) หรือระบบที่มุ่งเป้าไปยังกลุ่มเปราะบาง เช่น เด็กหรือผู้พิการ เพื่อแสวงหาประโยชน์โดยมิชอบ การกำหนดกลุ่มนี้ขึ้นมาเป็นการส่งสัญญาณที่ชัดเจนว่ามีขอบเขตทางจริยธรรมที่เทคโนโลยีไม่สามารถก้าวล่วงได้

กลุ่มความเสี่ยงสูง (High-Risk AI)

สำหรับ AI ในกลุ่มนี้ แม้จะไม่ถูกห้ามแต่จะอยู่ภายใต้การกำกับดูแลที่เข้มงวดเป็นพิเศษ เนื่องจากอาจส่งผลกระทบอย่างมีนัยสำคัญต่อความปลอดภัย สุขภาพ และสิทธิขั้นพื้นฐานของบุคคล ตัวอย่างเช่น ระบบ AI ที่ใช้ในทางการแพทย์เพื่อการวินิจฉัยโรค, ระบบที่ใช้ในการคัดเลือกบุคคลเข้าทำงานหรือให้สินเชื่อ, ระบบที่ใช้ในกระบวนการยุติธรรม หรือระบบยืนยันตัวตนด้วยข้อมูลชีวมิติ (Biometric Identification) เช่น เทคโนโลยีสแกนใบหน้าในพื้นที่สาธารณะ

ผู้พัฒนาและผู้ให้บริการ AI ในกลุ่มนี้จะต้องปฏิบัติตามข้อกำหนดที่เข้มงวดหลายประการ อาทิ:

- การบริหารจัดการความเสี่ยง (Risk Management): ต้องมีกระบวนการประเมินและลดความเสี่ยงตลอดวงจรชีวิตของระบบ AI

- การกำกับดูแลโดยมนุษย์ (Human Oversight): ต้องมีกลไกให้มนุษย์สามารถเข้ามาตรวจสอบและแทรกแซงการทำงานของระบบได้

- ความโปร่งใสและการให้ข้อมูล (Transparency and Information): ผู้ใช้ต้องได้รับข้อมูลที่ชัดเจนเกี่ยวกับการทำงานของระบบและผลลัพธ์ที่เกิดขึ้น

- การบันทึกเหตุการณ์ (Logging): ต้องมีการจัดเก็บบันทึกการทำงานของระบบเพื่อใช้ในการตรวจสอบย้อนหลัง

- การแต่งตั้งตัวแทนทางกฎหมาย: กรณีเป็นผู้ให้บริการจากต่างประเทศ จะต้องมีการแต่งตั้งตัวแทนทางกฎหมายในประเทศไทย เพื่อเป็นช่องทางในการติดต่อและรับผิดชอบ

| คุณลักษณะ | กลุ่มความเสี่ยงต้องห้าม (Prohibited AI) | กลุ่มความเสี่ยงสูง (High-Risk AI) |

|---|---|---|

| สถานะทางกฎหมาย | ไม่อนุญาตให้พัฒนาหรือใช้งานโดยเด็ดขาด | อนุญาตให้ใช้งานได้ภายใต้เงื่อนไขและการกำกับดูแลที่เข้มงวด |

| ลักษณะของ AI | เป็นภัยคุกคามต่อสิทธิมนุษยชนและค่านิยมพื้นฐานของสังคม | อาจส่งผลกระทบสำคัญต่อความปลอดภัยและสิทธิขั้นพื้นฐาน |

| ตัวอย่างการใช้งาน | ระบบให้คะแนนทางสังคม (Social Scoring), การชักจูงพฤติกรรมโดยไม่รู้ตัว | การวินิจฉัยทางการแพทย์, การคัดเลือกพนักงาน, การสแกนใบหน้าในที่สาธารณะ |

| มาตรการกำกับดูแล | การสั่งห้าม (Ban) | ต้องมีระบบบริหารความเสี่ยง, การกำกับโดยมนุษย์, ความโปร่งใส, และการแต่งตั้งตัวแทนทางกฎหมาย |

ผลกระทบต่อการคุ้มครองข้อมูลส่วนบุคคลและเทคโนโลยีสแกนใบหน้า

หนึ่งในประเด็นที่น่าจับตามองที่สุดของกฎหมาย AI ฉบับใหม่ คือผลกระทบโดยตรงต่อการคุ้มครองข้อมูลส่วนบุคคล (PDPA) และการกำกับดูแลเทคโนโลยีที่เกี่ยวข้องกับการใช้ข้อมูลชีวมิติ โดยเฉพาะเทคโนโลยีการจดจำใบหน้า (Facial Recognition) ซึ่งมีการใช้งานแพร่หลายมากขึ้นในปัจจุบัน

ก่อนหน้านี้ การใช้เทคโนโลยีสแกนใบหน้าอาจอยู่ภายใต้กรอบของ PDPA เป็นหลัก แต่กฎหมาย AI ฉบับใหม่จะยกระดับการกำกับดูแลให้มีความเฉพาะเจาะจงและเข้มข้นยิ่งขึ้น โดยจัดให้ระบบ AI ที่ใช้ในการระบุตัวตนด้วยข้อมูลชีวมิติในพื้นที่สาธารณะเป็น “AI ความเสี่ยงสูง” นั่นหมายความว่าองค์กรใดก็ตามที่ต้องการนำเทคโนโลยีนี้มาใช้ จะต้องเผชิญกับภาระหน้าที่และความรับผิดชอบที่เพิ่มขึ้นอย่างมีนัยสำคัญ

การเปลี่ยนแปลงที่คาดว่าจะเกิดขึ้นประกอบด้วย:

- ความจำเป็นและสัดส่วน (Necessity and Proportionality): การติดตั้งและใช้งานระบบสแกนใบหน้าในที่สาธารณะจะต้องสามารถพิสูจน์ได้ถึงความจำเป็นอย่างยิ่งยวดและต้องได้สัดส่วนกับวัตถุประสงค์ เช่น เพื่อการป้องกันอาชญากรรมร้ายแรง ไม่สามารถนำมาใช้เพื่อวัตถุประสงค์ทางการตลาดหรือการติดตามพฤติกรรมทั่วไปของประชาชนได้โดยง่าย

- การประเมินผลกระทบ (Impact Assessment): ก่อนการติดตั้งระบบ ผู้ให้บริการจะต้องจัดทำการประเมินผลกระทบด้านสิทธิมนุษยชนและความเป็นส่วนตัว เพื่อระบุและหาแนวทางบรรเทาความเสี่ยงที่อาจเกิดขึ้น

- ความโปร่งใสในการใช้งาน: ประชาชนจะต้องได้รับแจ้งอย่างชัดเจนเมื่อเข้าสู่พื้นที่ที่มีการใช้ระบบสแกนใบหน้า รวมถึงต้องได้รับข้อมูลเกี่ยวกับวัตถุประสงค์ของการเก็บข้อมูลและระยะเวลาในการจัดเก็บ

- ความปลอดภัยของข้อมูล: มาตรฐานการรักษาความปลอดภัยของข้อมูลชีวมิติที่ถูกเก็บรวบรวมจะต้องมีความรัดกุมสูงสุด เพื่อป้องกันการรั่วไหลหรือการนำไปใช้ในทางที่ผิด

กฎหมายนี้จะสร้างมาตรฐานใหม่ให้กับการใช้ข้อมูลส่วนบุคคลโดย AI เพื่อให้มั่นใจว่าการประมวลผลข้อมูลเป็นไปอย่างเป็นธรรม ถูกต้องตามกฎหมาย และเคารพต่อความเป็นส่วนตัว ซึ่งจะช่วยสร้างความเชื่อมั่นให้กับประชาชนในการใช้บริการดิจิทัลต่างๆ และลดความกังวลเกี่ยวกับการถูกสอดส่องหรือการนำข้อมูลไปใช้โดยไม่ได้รับอนุญาต

กลไกการกำกับดูแล: ศูนย์ AIGPC และ Monitoring Dashboard

เพื่อให้การบังคับใช้กฎหมายเป็นไปอย่างมีประสิทธิภาพ ประเทศไทยได้เตรียมการจัดตั้งกลไกการกำกับดูแลขึ้นมาโดยเฉพาะ ซึ่งนับเป็นความก้าวหน้าที่สำคัญในระดับภูมิภาค การจัดตั้งศูนย์กลางด้านการกำกับดูแล AI (AI Governance Practice Center – AIGPC) ถือเป็นการวางโครงสร้างพื้นฐานด้านการกำกับดูแลที่ชัดเจนและเป็นรูปธรรม ซึ่งถือเป็นแห่งแรกในภูมิภาคอาเซียน

ศูนย์ AIGPC จะทำหน้าที่เป็นหน่วยงานกลางในการส่งเสริมและกำกับการพัฒนาและใช้งาน AI ให้สอดคล้องกับหลักจริยธรรมและข้อกฎหมาย ภารกิจของศูนย์จะครอบคลุมตั้งแต่การให้คำปรึกษาแก่ผู้ประกอบการ, การออกมาตรฐานและแนวปฏิบัติ, การตรวจสอบการปฏิบัติตามกฎหมาย, ไปจนถึงการรับเรื่องร้องเรียนจากประชาชนที่ได้รับผลกระทบจากการใช้ AI การมีหน่วยงานเฉพาะทางเช่นนี้จะช่วยให้การกำกับดูแลเป็นไปอย่างต่อเนื่องและทันต่อการเปลี่ยนแปลงของเทคโนโลยี

นอกจากนี้ อีกหนึ่งเครื่องมือสำคัญที่จะถูกนำมาใช้คือ “Monitoring Dashboard” หรือแผงควบคุมการเฝ้าระวัง ซึ่งเป็นเครื่องมือดิจิทัลที่จะช่วยให้หน่วยงานกำกับดูแลสามารถติดตามและประเมินการใช้งาน AI ในภาพรวมของประเทศได้ Dashboard นี้จะรวบรวมข้อมูลเกี่ยวกับระบบ AI ความเสี่ยงสูงที่ใช้งานอยู่ในประเทศ, รายงานเหตุการณ์ผิดปกติ (Incidents) ที่เกิดขึ้น, และข้อมูลอื่นๆ ที่จำเป็นต่อการวิเคราะห์แนวโน้มและประเมินความเสี่ยง

การทำงานร่วมกันของศูนย์ AIGPC และ Monitoring Dashboard จะสร้างระบบนิเวศการกำกับดูแลที่โปร่งใสและขับเคลื่อนด้วยข้อมูล (Data-Driven) ทำให้สามารถระบุปัญหาและออกมาตรการตอบสนองได้อย่างรวดเร็วและแม่นยำ กลไกเหล่านี้ไม่เพียงแต่จะช่วยบังคับใช้กฎหมายเท่านั้น แต่ยังทำหน้าที่เป็นแหล่งความรู้และศูนย์กลางในการสร้างความตระหนักรู้เกี่ยวกับจริยธรรม AI ให้กับทุกภาคส่วนในสังคมอีกด้วย

ขั้นตอนและกรอบเวลาสู่การบังคับใช้

กระบวนการจัดทำร่างกฎหมาย AI ฉบับนี้ได้ดำเนินมาอย่างต่อเนื่องและเป็นระบบ โดยมีการเปิดรับฟังความคิดเห็นจากภาคส่วนต่างๆ เพื่อให้กฎหมายมีความสมบูรณ์และตอบโจทย์บริบทของประเทศไทยมากที่สุด โดยล่าสุด กระบวนการรับฟังความคิดเห็นสาธารณะได้สิ้นสุดลงแล้วเมื่อวันที่ 9 มิถุนายน 2568 ที่ผ่านมา ซึ่งถือเป็นก้าวสำคัญที่แสดงให้เห็นถึงความพร้อมในการผลักดันร่างกฎหมายเข้าสู่กระบวนการพิจารณาในลำดับต่อไป

ตามแผนการที่วางไว้ ร่างกฎหมายฉบับนี้มีกำหนดการเปิดตัวอย่างเป็นทางการในเวทีระดับนานาชาติ คืองาน The 3rd UNESCO Global Forum on the Ethics of AI 2025 ซึ่งประเทศไทยได้รับเกียรติให้เป็นเจ้าภาพ การเปิดตัวในเวทีนี้ไม่เพียงแต่จะเป็นการประกาศความพร้อมของไทย แต่ยังเป็นการแสดงวิสัยทัศน์และบทบาทนำในด้านจริยธรรมดิจิทัลในระดับโลกอีกด้วย

หลังจากนั้น ขั้นตอนต่อไปคือการนำร่างกฎหมายเสนอต่อคณะรัฐมนตรี (ครม.) เพื่อพิจารณาให้ความเห็นชอบ ก่อนจะเข้าสู่กระบวนการพิจารณาของรัฐสภาตามลำดับ หากทุกอย่างเป็นไปตามแผนที่วางไว้ คาดว่ากฎหมาย AI ฉบับแรกของไทยจะสามารถประกาศบังคับใช้ได้ภายในช่วงปี พ.ศ. 2568 ถึง 2569 ซึ่งจะทำให้ประเทศไทยเป็นหนึ่งในกลุ่มประเทศแรกๆ ในภูมิภาคที่มีกฎหมายกำกับดูแลปัญญาประดิษฐ์โดยเฉพาะ

ทิศทางของไทยบนเวทีจริยธรรมดิจิทัลระดับโลก

การพัฒนากฎหมาย AI ฉบับนี้ไม่ได้มองแค่บริบทภายในประเทศเท่านั้น แต่ยังคำนึงถึงมาตรฐานและแนวปฏิบัติในระดับสากลด้วย โดยเฉพาะอย่างยิ่งเมื่อเปรียบเทียบกับกฎหมาย AI ของสหภาพยุโรป (EU AI Act) ซึ่งถือเป็นกฎหมายที่ครอบคลุมและมีอิทธิพลต่อแนวทางการกำกับดูแล AI ทั่วโลก และกำลังจะเริ่มบังคับใช้อย่างจริงจังในปี 2025

แนวทางของประเทศไทยมีความพยายามที่จะเรียนรู้จากประสบการณ์ของ EU แต่ในขณะเดียวกันก็ปรับให้เข้ากับบริบทของประเทศ โดยมีเป้าหมายที่ชัดเจนว่าจะไม่สร้างกฎระเบียบที่เข้มงวดจนเกินไปจนกลายเป็นอุปสรรคต่อการวิจัยและพัฒนา หรือขัดขวางนวัตกรรมใหม่ๆ แต่จะเน้นการสร้างกรอบการทำงานที่ส่งเสริมให้เกิดการพัฒนา AI ที่มีความรับผิดชอบ (Responsible AI) และน่าเชื่อถือ (Trustworthy AI)

ด้วยการเป็นเจ้าภาพจัดงาน UNESCO Global Forum on the Ethics of AI และการมีศูนย์ AIGPC เป็นแห่งแรกในอาเซียน ประเทศไทยกำลังแสดงบทบาทผู้นำในภูมิภาคด้านการกำกับดูแลและส่งเสริมจริยธรรมดิจิทัล การมีกฎหมายที่ชัดเจนและทันสมัยจะช่วยเพิ่มความน่าสนใจในการลงทุนด้านเทคโนโลยีจากต่างประเทศ และยกระดับขีดความสามารถในการแข่งขันของอุตสาหกรรมดิจิทัลไทยในระยะยาว การวางรากฐานด้านกฎหมายและจริยธรรมที่แข็งแกร่งในวันนี้ จึงเป็นการเตรียมความพร้อมสำหรับอนาคตที่ปัญญาประดิษฐ์จะมีบทบาทสำคัญในทุกมิติของสังคมและเศรษฐกิจ

บทสรุป: เตรียมพร้อมรับความเปลี่ยนแปลง

การมาถึงของกฎหมาย AI ฉบับแรกของประเทศไทยนับเป็นจุดเปลี่ยนที่สำคัญ ซึ่งจะส่งผลกระทบในวงกว้างต่อทั้งภาคธุรกิจ ภาครัฐ และประชาชนทั่วไป กฎหมายนี้ไม่ได้เป็นเพียงข้อบังคับ แต่เป็นเครื่องมือสำคัญในการสร้างสมดุลระหว่างการขับเคลื่อนนวัตกรรมทางเทคโนโลยีและการคุ้มครองสิทธิขั้นพื้นฐานของบุคคล โดยเฉพาะอย่างยิ่งในด้านความเป็นส่วนตัวและการใช้ข้อมูลส่วนบุคคล

สำหรับภาคธุรกิจและนักพัฒนา การทำความเข้าใจในข้อกำหนดต่างๆ โดยเฉพาะการจำแนก AI ตามระดับความเสี่ยง และภาระหน้าที่ที่เกี่ยวข้องกับ AI ความเสี่ยงสูง เป็นสิ่งจำเป็นอย่างยิ่งในการวางแผนพัฒนาและนำเสนอผลิตภัณฑ์และบริการในอนาคต การปรับตัวให้สอดคล้องกับมาตรฐานใหม่นี้ไม่เพียงแต่จะช่วยลดความเสี่ยงทางกฎหมาย แต่ยังเป็นการสร้างความเชื่อมั่นให้กับผู้บริโภคและยกระดับมาตรฐานขององค์กร

สำหรับประชาชนทั่วไป กฎหมายฉบับนี้จะเข้ามาเสริมสร้างความคุ้มครองในการใช้ชีวิตประจำวันยุคดิจิทัลให้แข็งแกร่งขึ้น การกำกับดูแลการใช้เทคโนโลยีสแกนใบหน้าและระบบ AI อื่นๆ ที่เกี่ยวข้องกับข้อมูลส่วนตัวอย่างเข้มงวด จะช่วยให้ประชาชนมีความมั่นใจมากขึ้นว่าสิทธิของตนจะได้รับการเคารพ

การเตรียมความพร้อมและติดตามความคืบหน้าของกฎหมาย AI อย่างใกล้ชิด จึงเป็นสิ่งที่ทุกภาคส่วนควรให้ความสำคัญ เพื่อให้สามารถปรับตัวรับมือกับการเปลี่ยนแปลง และร่วมกันสร้างระบบนิเวศปัญญาประดิษฐ์ของไทยให้เติบโตอย่างมีคุณภาพ ปลอดภัย และยั่งยืนต่อไป