ศาล AI ตัดสิน! คนจนติดคุกฟรี สังคมเดือด

- ภาพรวมของปัญญาประดิษฐ์ในกระบวนการยุติธรรม

- ความยุติธรรมในยุคดิจิทัล: เมื่อ AI ก้าวสู่บัลลังก์ศาล

- เทคโนโลยี AI ในกระบวนการยุติธรรมไทย: สถานะปัจจุบันและความเป็นจริง

- บทเรียนจากต่างแดน: เมื่ออัลกอริทึมตัดสินชีวิตคน

- ความเสี่ยงและผลกระทบ: สองคมดาบของศาล AI

- แนวทางรับมือและอนาคตของกระบวนการยุติธรรม

- สรุป: ก้าวต่อไปของ AI กับความยุติธรรมไทย

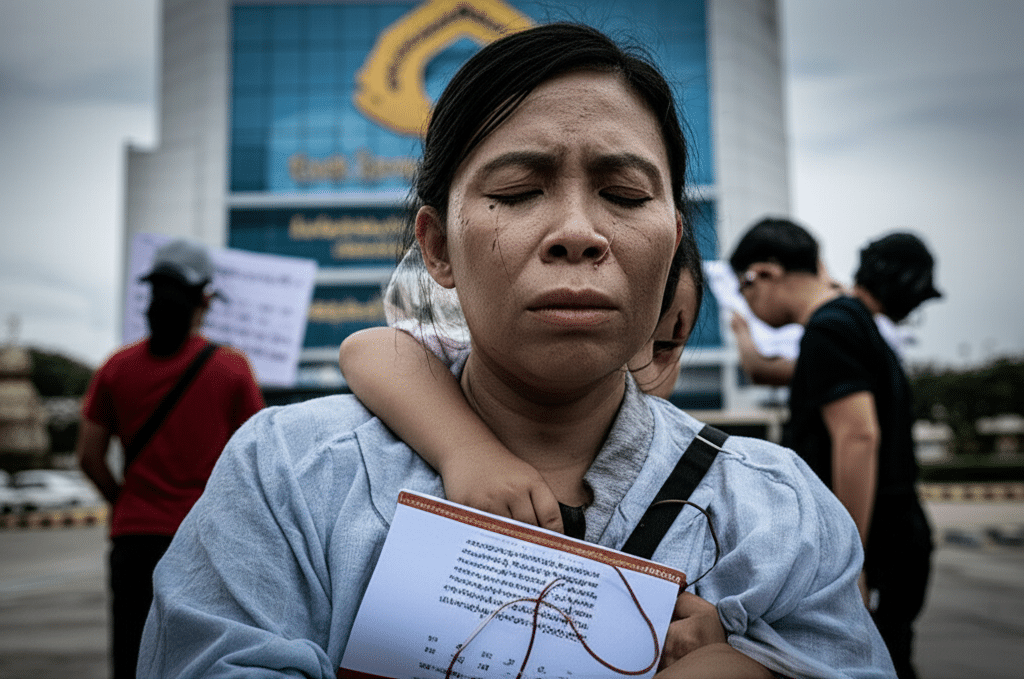

ประเด็นเรื่อง ศาล AI ตัดสิน! คนจนติดคุกฟรี สังคมเดือด ได้กลายเป็นหัวข้อถกเถียงที่สร้างความกังวลในวงกว้าง สะท้อนถึงความหวาดระแวงต่อการนำเทคโนโลยีปัญญาประดิษฐ์ (AI) เข้ามาใช้ในกระบวนการยุติธรรม แม้ว่าแนวคิดเรื่องผู้พิพากษา AI จะยังไม่เกิดขึ้นจริงในประเทศไทย แต่ความกลัวว่าอัลกอริทึมที่ซ่อนเร้นอคติอาจนำไปสู่การตัดสินที่ผิดพลาดและส่งผลกระทบต่อกลุ่มคนเปราะบางในสังคมนั้นเป็นสิ่งที่ไม่อาจมองข้ามได้ ปรากฏการณ์นี้จุดประกายคำถามสำคัญเกี่ยวกับความน่าเชื่อถือ ความเป็นธรรม และอนาคตของระบบยุติธรรมในยุคดิจิทัล

ภาพรวมของปัญญาประดิษฐ์ในกระบวนการยุติธรรม

- สถานะในประเทศไทย: ปัจจุบันประเทศไทยมีการนำ AI มาใช้ในลักษณะเครื่องมือสนับสนุนการทำงานของศาล เช่น การวิเคราะห์ข้อมูลคดี เพื่อเพิ่มประสิทธิภาพและความรวดเร็ว ยังไม่มีการใช้ AI ในการตัดสินคดีโดยตรง

- ความเสี่ยงจากอคติ: ความกังวลหลักคือ “อคติอัลกอริทึม” (Algorithmic Bias) ซึ่ง AI อาจเรียนรู้และขยายอคติที่มีอยู่แล้วในสังคมจากข้อมูลที่ใช้ฝึกฝน ส่งผลให้การตัดสินไม่เป็นธรรมต่อกลุ่มคนบางกลุ่ม โดยเฉพาะผู้ด้อยโอกาส

- บทเรียนจากต่างประเทศ: มีกรณีศึกษาในต่างประเทศที่ระบบ AI ทำงานผิดพลาดและนำไปสู่การตัดสินลงโทษผู้บริสุทธิ์ ซึ่งเป็นเครื่องยืนยันว่าความเสี่ยงดังกล่าวมีอยู่จริงและสร้างผลกระทบร้ายแรง

- ความจำเป็นในการกำกับดูแล: การพัฒนา AI สำหรับกระบวนการยุติธรรมจำเป็นต้องมีกรอบการกำกับดูแลที่รัดกุม หลักการด้านจริยธรรมที่ชัดเจน และการตรวจสอบโดยมนุษย์ เพื่อป้องกันความผิดพลาดและสร้างความเชื่อมั่นต่อสาธารณะ

- อนาคตของเทคโนโลยี: การถกเถียงเรื่องศาล AI ไม่ใช่แค่เรื่องเทคโนโลยี แต่เป็นเรื่องการสร้างหลักประกันว่านวัตกรรมจะถูกนำมาใช้เพื่อส่งเสริมความยุติธรรมอย่างเท่าเทียม ไม่ใช่สร้างความเหลื่อมล้ำให้มากขึ้น

ความยุติธรรมในยุคดิจิทัล: เมื่อ AI ก้าวสู่บัลลังก์ศาล

ในยุคที่เทคโนโลยีปัญญาประดิษฐ์ (AI) แทรกซึมเข้าไปในทุกภาคส่วนของสังคม แนวคิดการนำ AI มาประยุกต์ใช้ในกระบวนการยุติธรรมจึงไม่ใช่เรื่องไกลตัวอีกต่อไป การเพิ่มขึ้นของปริมาณคดีความที่ซับซ้อนและความต้องการกระบวนการที่รวดเร็วและมีประสิทธิภาพมากขึ้น ผลักดันให้องค์กรตุลาการทั่วโลก รวมถึงประเทศไทย เริ่มศึกษาและทดลองนำ AI มาเป็นเครื่องมือสนับสนุนการทำงาน เรื่องนี้จึงกลายเป็นประเด็นสำคัญที่สังคมต้องให้ความสนใจ เพราะมันไม่ได้ส่งผลกระทบต่อนักกฎหมายหรือบุคลากรในกระบวนการยุติธรรมเท่านั้น แต่ยังส่งผลโดยตรงต่อสิทธิเสรีภาพและชีวิตของประชาชนทุกคน

ความสำคัญของหัวข้อนี้อยู่ที่การหาจุดสมดุลระหว่าง “ประสิทธิภาพ” ที่เทคโนโลยีหยิบยื่นให้ กับ “ความเป็นธรรม” ซึ่งเป็นหัวใจหลักของกระบวนการยุติธรรม การใช้ AI อาจช่วยลดระยะเวลาในการพิจารณาคดี วิเคราะห์หลักฐานจำนวนมหาศาลได้อย่างรวดเร็ว และลดความผิดพลาดที่เกิดจากปัจเจกบุคคลได้ แต่ในทางกลับกัน ก็มีความเสี่ยงที่ซ่อนอยู่อย่างมหาศาล โดยเฉพาะอย่างยิ่งปัญหา “อคติของอัลกอริทึม” ที่อาจตัดสินอย่างไม่เป็นธรรมต่อกลุ่มคนเปราะบางและผู้ด้อยโอกาสทางสังคม ซึ่งเป็นกลุ่มที่มักจะเข้าถึงทรัพยากรในการต่อสู้คดีได้อย่างจำกัด การถกเถียงเรื่องศาล AI จึงเป็นเรื่องของทุกคนที่ต้องการเห็นสังคมที่มีความยุติธรรมที่โปร่งใสและเท่าเทียมอย่างแท้จริง

เทคโนโลยี AI ในกระบวนการยุติธรรมไทย: สถานะปัจจุบันและความเป็นจริง

แม้ว่าหัวข้อ “ศาล AI” จะถูกพูดถึงอย่างแพร่หลายและสร้างภาพจำถึงผู้พิพากษาหุ่นยนต์ที่ทำการตัดสินคดี แต่ในบริบทของประเทศไทย สถานการณ์จริงยังคงแตกต่างออกไป ปัจจุบัน การนำ AI มาใช้ในระบบศาลไทยยังอยู่ในระยะเริ่มต้นและมุ่งเน้นไปที่การเป็น “ผู้ช่วย” เพื่อเพิ่มประสิทธิภาพการทำงานของบุคลากร มากกว่าที่จะเข้ามาทำหน้าที่ “ตัดสิน” แทนมนุษย์โดยตรง

โครงการนำร่องและความร่วมมือ

ความเคลื่อนไหวที่ชัดเจนที่สุดคือความร่วมมือระหว่างสำนักงานศาลปกครองของไทย และศูนย์เทคโนโลยีอิเล็กทรอนิกส์และคอมพิวเตอร์แห่งชาติ (เนคเทค สวทช.) ในการพัฒนาและนำเทคโนโลยี AI สมัยใหม่เข้ามาประยุกต์ใช้ โครงการนี้มุ่งเน้นการใช้ Generative AI และ Large Language Model (LLM) ที่มีความสามารถในการทำความเข้าใจภาษากฎหมายไทยโดยเฉพาะ ซึ่งเป็นภาษาที่มีความซับซ้อนและศัพท์เฉพาะทางจำนวนมาก

เทคโนโลยีดังกล่าวถูกออกแบบมาเพื่อทำหน้าที่วิเคราะห์และประมวลผลข้อมูลจากสำนวนคดีที่มีอยู่เป็นจำนวนมาก ยกตัวอย่างเช่น การสรุปข้อเท็จจริงจากเอกสารหลายร้อยหน้า, การค้นหา判例ที่เกี่ยวข้องกับคดีปัจจุบัน, หรือการตรวจสอบความสอดคล้องของคำให้การและพยานหลักฐานต่างๆ การทำงานในลักษณะนี้ช่วยให้ผู้พิพากษาและเจ้าหน้าที่ศาลสามารถเข้าถึงข้อมูลสำคัญได้อย่างรวดเร็วและแม่นยำยิ่งขึ้น

เป้าหมายหลัก: การสนับสนุน ไม่ใช่การตัดสิน

วัตถุประสงค์หลักของการนำ AI เข้ามาใช้ในกระบวนการศาลปกครองไทย ณ ปัจจุบัน คือการลดภาระงานที่ซ้ำซ้อนและใช้เวลามาก เพื่อให้บุคลากรสามารถทุ่มเทสติปัญญาและเวลาไปกับการวิเคราะห์ประเด็นทางกฎหมายที่ซับซ้อนและการใช้ดุลยพินิจได้อย่างเต็มที่ กล่าวคือ AI ทำหน้าที่เป็นเครื่องมือสืบค้นและวิเคราะห์ข้อมูลขั้นสูง แต่การตีความ การชั่งน้ำหนักพยานหลักฐาน และการวินิจฉัยชี้ขาดในท้ายที่สุดยังคงเป็นอำนาจและหน้าที่ของผู้พิพากษาที่เป็นมนุษย์แต่เพียงผู้เดียว

ดังนั้น สถานการณ์ที่ AI จะทำการตัดสินคดีโดยอัตโนมัติและส่งผลให้มีผู้ถูกจำคุกโดยที่ไม่มีมนุษย์เข้ามาเกี่ยวข้องนั้น ยังไม่มีรายงานว่าเกิดขึ้นจริงในประเทศไทย แนวทางของไทยในปัจจุบันสะท้อนให้เห็นถึงความระมัดระวังในการนำเทคโนโลยีมาปรับใช้ โดยให้ความสำคัญกับการรักษาบทบาทของดุลยพินิจมนุษย์ไว้เป็นแกนกลางของกระบวนการยุติธรรม

บทเรียนจากต่างแดน: เมื่ออัลกอริทึมตัดสินชีวิตคน

ในขณะที่ประเทศไทยยังคงอยู่ในขั้นของการนำ AI มาใช้เพื่อสนับสนุนการทำงาน ความกังวลเกี่ยวกับผลกระทบเชิงลบนั้นไม่ได้เกิดขึ้นจากจินตนาการ แต่มีรากฐานมาจากเหตุการณ์จริงที่เกิดขึ้นในต่างประเทศ กรณีศึกษาเหล่านี้เป็นเหมือนสัญญาณเตือนภัยที่ชี้ให้เห็นถึงอันตรายของ “อคติอัลกอริทึม” (Algorithmic Bias) และความเสี่ยงที่จะนำไปสู่ภาวะวิกฤตศรัทธาในกระบวนการยุติธรรม

อคติอัลกอริทึม: กระจกสะท้อนความเหลื่อมล้ำ

อคติอัลกอริทึม คือปรากฏการณ์ที่ระบบ AI สร้างผลลัพธ์ที่ไม่เป็นธรรมอย่างเป็นระบบ โดยมีสาเหตุหลักมาจากการที่ AI ถูกฝึกฝนด้วยชุดข้อมูลที่มีอคติแฝงอยู่แล้ว AI ไม่ได้มีความคิดหรืออคติเป็นของตัวเอง แต่มันเรียนรู้และทำซ้ำรูปแบบที่พบในข้อมูลที่ได้รับ หากข้อมูลทางประวัติศาสตร์ที่ใช้ฝึกฝน AI สะท้อนถึงอคติของสังคมที่มีต่อเชื้อชาติ, เพศ, หรือสถานะทางเศรษฐกิจ ระบบ AI ก็จะเรียนรู้และนำอคตินั้นมาใช้ในการตัดสินใจของมันด้วย และบ่อยครั้งที่มันขยายอคตินั้นให้รุนแรงยิ่งขึ้น

ตัวอย่างเช่น หากข้อมูลอาชญากรรมในอดีตแสดงให้เห็นถึงการจับกุมในชุมชนคนจนที่สูงกว่า ไม่ว่าจะเป็นเพราะอัตราการก่อเหตุที่สูงจริงหรือเป็นผลมาจากการเฝ้าระวังของตำรวจที่เข้มข้นกว่าในพื้นที่นั้น AI ที่ถูกฝึกด้วยข้อมูลนี้ก็อาจสรุปผลว่าบุคคลที่มาจากชุมชนดังกล่าวมีความเสี่ยงที่จะกระทำผิดซ้ำสูงกว่า ซึ่งอาจส่งผลต่อการตัดสินใจให้ประกันตัวหรือการกำหนดบทลงโทษที่ไม่เป็นธรรม

กรณีศึกษา: ความผิดพลาดที่สร้างวิกฤตศรัทธา

หนึ่งในตัวอย่างที่ถูกหยิบยกขึ้นมาบ่อยครั้งคือระบบวิเคราะห์เสียงปืน เช่น เทคโนโลยี ShotSpotter ซึ่งใช้ไมโครโฟนตรวจจับเสียงที่คล้ายเสียงปืนและระบุตำแหน่งเพื่อแจ้งตำรวจให้เข้าระงับเหตุอย่างรวดเร็ว ข้อมูลจากระบบนี้ถูกนำไปใช้เป็นหลักฐานในชั้นศาลในหลายคดีในสหรัฐอเมริกา อย่างไรก็ตาม มีกรณีที่ชายคนหนึ่งถูกตัดสินจำคุกจากหลักฐานของระบบนี้ ก่อนที่ภายหลังจะพบว่าเสียงที่ระบบตรวจจับได้อาจไม่ใช่เสียงปืนจริง ทำให้เขาต้องติดคุกฟรีเป็นเวลาเกือบหนึ่งปี กรณีเช่นนี้ได้จุดประกายให้เกิดการตั้งคำถามอย่างรุนแรงถึงความน่าเชื่อถือของหลักฐานที่ได้มาจาก AI และความเสี่ยงในการลงโทษผู้บริสุทธิ์

บทเรียนจากต่างประเทศแสดงให้เห็นอย่างชัดเจนว่า การพึ่งพาระบบ AI โดยขาดความเข้าใจในข้อจำกัดและความโปร่งใสของอัลกอริทึมนั้นอันตรายอย่างยิ่ง ความผิดพลาดของ AI ไม่ใช่แค่ข้อบกพร่องทางเทคนิค แต่เป็นความผิดพลาดที่ส่งผลกระทบต่อชีวิตและอิสรภาพของมนุษย์โดยตรง และบ่อนทำลายความเชื่อมั่นของประชาชนที่มีต่อกระบวนการยุติธรรมซึ่งเป็นเสาหลักของสังคม

ความเสี่ยงและผลกระทบ: สองคมดาบของศาล AI

การนำปัญญาประดิษฐ์มาใช้ในกระบวนการยุติธรรมเปรียบเสมือนดาบสองคม ด้านหนึ่งมีศักยภาพในการปฏิรูประบบให้มีประสิทธิภาพและรวดเร็วยิ่งขึ้น แต่อีกด้านหนึ่งก็แฝงไว้ด้วยความเสี่ยงและผลกระทบเชิงลบที่อาจกัดกร่อนหลักการพื้นฐานของความยุติธรรมได้ การพิจารณาอย่างรอบด้านถึงโอกาสและความท้าทายจึงเป็นสิ่งจำเป็นอย่างยิ่ง

| มิติการพิจารณา | โอกาสและประโยชน์ | ความเสี่ยงและข้อกังวล |

|---|---|---|

| ประสิทธิภาพและความเร็ว | สามารถประมวลผลข้อมูลและเอกสารจำนวนมหาศาลได้ในเวลาอันสั้น ช่วยลดระยะเวลาในการดำเนินคดีและลดภาระงานของบุคลากร | การพึ่งพาเทคโนโลยีมากเกินไปอาจนำไปสู่การมองข้ามข้อผิดพลาดเล็กๆ น้อยๆ ที่อาจส่งผลกระทบใหญ่หลวง และลดทักษะการวิเคราะห์เชิงลึกของมนุษย์ |

| ความแม่นยำและความสม่ำเสมอ | AI สามารถตรวจจับรูปแบบหรือความเชื่อมโยงในพยานหลักฐานที่มนุษย์อาจมองข้าม และให้ผลลัพธ์ที่สม่ำเสมอ ไม่ขึ้นอยู่กับอารมณ์หรือความเหนื่อยล้า | หลักการ “ขยะเข้า ขยะออก” (Garbage In, Garbage Out) หากข้อมูลที่ใช้ฝึกฝน AI มีคุณภาพต่ำหรือมีอคติ ผลลัพธ์ที่ได้ก็จะผิดพลาดและไม่น่าเชื่อถือ |

| ความเป็นกลางและความยุติธรรม | ในทางทฤษฎี AI ไม่มีอคติส่วนตัวเหมือนมนุษย์ จึงอาจช่วยลดอิทธิพลของความลำเอียงส่วนบุคคลในการตัดสินใจได้ | อคติอัลกอริทึมที่เกิดจากข้อมูลที่ไม่เป็นกลาง สามารถสร้างความไม่เท่าเทียมอย่างเป็นระบบและยากต่อการตรวจสอบกว่าอคติของมนุษย์ |

| ความโปร่งใสและการตรวจสอบ | AI บางประเภทสามารถให้เหตุผลประกอบการตัดสินใจได้ ซึ่งอาจทำให้กระบวนการโปร่งใสขึ้น | “ปัญหา กล่องดำ” (Black Box Problem) ใน AI หลายระบบ ที่ไม่สามารถอธิบายเหตุผลเบื้องหลังการตัดสินใจได้อย่างชัดเจน ทำให้การตรวจสอบและคัดค้านเป็นไปได้ยาก |

ผลกระทบที่น่ากังวลที่สุดคือการที่ AI อาจทำให้ความเหลื่อมล้ำในสังคมเลวร้ายลงไปอีก กลุ่มคนจนและผู้ด้อยโอกาสมักมีข้อจำกัดในการเข้าถึงทนายความหรือผู้เชี่ยวชาญที่สามารถต่อสู้กับหลักฐานที่สร้างโดย AI ที่ซับซ้อนได้ หากระบบยุติธรรมพึ่งพาเทคโนโลยีเหล่านี้มากขึ้นโดยไม่มีมาตรการรองรับที่เพียงพอ ก็อาจเป็นการสร้างกำแพงที่มองไม่เห็นซึ่งกีดกันคนกลุ่มนี้ออกจากการเข้าถึงความยุติธรรมที่แท้จริง

แนวทางรับมือและอนาคตของกระบวนการยุติธรรม

เพื่อควบคุมความเสี่ยงและนำศักยภาพของ AI มาใช้ให้เกิดประโยชน์สูงสุดต่อกระบวนการยุติธรรม การวางกรอบการกำกับดูแลและหลักการทางจริยธรรมที่ชัดเจนจึงเป็นสิ่งที่ไม่สามารถหลีกเลี่ยงได้ อนาคตของความยุติธรรมไม่ได้ขึ้นอยู่กับความก้าวหน้าของเทคโนโลยีเพียงอย่างเดียว แต่ขึ้นอยู่กับความสามารถในการสร้างหลักประกันว่าเทคโนโลยีนั้นจะถูกใช้อย่างมีความรับผิดชอบ

ความโปร่งใสและหลักการที่ตรวจสอบได้

หลักการที่สำคัญที่สุดประการหนึ่งคือ “ความโปร่งใส” (Transparency) อัลกอริทึมที่ใช้ในกระบวนการยุติธรรมจะต้องไม่เป็น “กล่องดำ” ที่ไม่มีใครสามารถเข้าใจได้ แต่ต้องสามารถอธิบายเหตุผลและกระบวนการในการได้มาซึ่งผลลัพธ์นั้นๆ ได้ (Explainable AI – XAI) เพื่อให้คู่ความ ทนายความ และผู้พิพากษา สามารถตรวจสอบความถูกต้องและโต้แย้งผลลัพธ์ของ AI ได้หากจำเป็น นอกจากนี้ ชุดข้อมูลที่ใช้ในการฝึกฝน AI ก็ควรเปิดให้มีการตรวจสอบเพื่อประเมินหาอคติที่อาจแฝงอยู่

การกำกับดูแลโดยมนุษย์

หลักการ “มนุษย์เป็นศูนย์กลาง” (Human-in-the-loop) เป็นอีกหนึ่งหัวใจสำคัญ AI ควรถูกวางบทบาทให้เป็นเครื่องมือสนับสนุนการตัดสินใจของผู้พิพากษา ไม่ใช่ผู้ทำการตัดสินใจเสียเอง ดุลยพินิจ ประสบการณ์ และความเข้าใจในบริบททางสังคมและมนุษยธรรมของผู้พิพากษาที่เป็นมนุษย์ยังคงเป็นสิ่งที่เทคโนโลยีไม่สามารถทดแทนได้ การตัดสินใจสุดท้ายที่ส่งผลต่อสิทธิและเสรีภาพของบุคคลจะต้องมาจากมนุษย์เสมอ

ความท้าทายที่สำคัญที่สุดไม่ใช่การสร้าง AI ที่ฉลาดขึ้น แต่คือการสร้างหลักประกันว่าเทคโนโลยีจะรับใช้ความยุติธรรมอย่างแท้จริง ไม่ใช่สร้างวิกฤตศรัทธาครั้งใหม่

นอกจากนี้ การพัฒนากรอบกฎหมายและข้อบังคับที่เฉพาะเจาะจงสำหรับการใช้ AI ในศาลเป็นสิ่งจำเป็น เพื่อกำหนดมาตรฐานของพยานหลักฐานที่ได้จาก AI, กระบวนการในการนำเสนอและคัดค้านหลักฐานดังกล่าว และการกำหนดความรับผิดชอบในกรณีที่เกิดความผิดพลาดขึ้น การเตรียมความพร้อมด้านบุคลากรในกระบวนการยุติธรรมให้มีความรู้ความเข้าใจในเทคโนโลยี AI ก็เป็นอีกปัจจัยสำคัญที่จะทำให้อนาคตของกระบวนการยุติธรรมก้าวไปข้างหน้าได้อย่างมั่นคงและเป็นธรรม

สรุป: ก้าวต่อไปของ AI กับความยุติธรรมไทย

ปรากฏการณ์ความกังวลในหัวข้อ ศาล AI ตัดสิน! คนจนติดคุกฟรี สังคมเดือด เป็นภาพสะท้อนที่ชัดเจนถึงความท้าทายและความหวาดระแวงที่สังคมมีต่อการเข้ามาของเทคโนโลยีปัญญาประดิษฐ์ในพื้นที่ที่ละเอียดอ่อนอย่างกระบวนการยุติธรรม จากข้อมูลที่มีอยู่ สามารถสรุปได้ว่าสถานการณ์ดังกล่าวเป็นเสมือน “เรื่องเล่าเตือนใจ” มากกว่าจะเป็นความจริงที่เกิดขึ้นแล้วในบริบทของประเทศไทยในปัจจุบัน

ระบบยุติธรรมไทยกำลังอยู่ในช่วงเริ่มต้นของการสำรวจและนำ AI มาใช้ในฐานะเครื่องมือสนับสนุน เพื่อเพิ่มประสิทธิภาพและความแม่นยำในการจัดการข้อมูลคดี โดยยังคงสงวนอำนาจการตัดสินใจและดุลยพินิจสุดท้ายไว้กับผู้พิพากษาที่เป็นมนุษย์ อย่างไรก็ตาม บทเรียนราคาแพงจากกรณีศึกษาในต่างประเทศได้แสดงให้เห็นแล้วว่าความเสี่ยงจากอคติของอัลกอริทึมและการทำงานที่ผิดพลาดของ AI นั้นเป็นเรื่องจริงและสามารถสร้างผลกระทบร้ายแรงต่อชีวิตผู้คนและบ่อนทำลายความเชื่อมั่นต่อระบบยุติธรรมได้

ดังนั้น ก้าวต่อไปของ AI กับความยุติธรรมไทยจึงต้องดำเนินไปบนเส้นทางของความระมัดระวัง การสร้างสมดุลระหว่างการเปิดรับนวัตกรรมเพื่อการพัฒนาและการสร้างกลไกป้องกันที่แข็งแกร่งเป็นสิ่งสำคัญยิ่ง การพัฒนาต้องควบคู่ไปกับการสร้างความโปร่งใสที่ตรวจสอบได้, การกำหนดกรอบจริยธรรมและกฎหมายที่รัดกุม, และการยืนยันหลักการให้มนุษย์เป็นผู้กำกับดูแลและตัดสินใจในขั้นตอนสุดท้ายเสมอ การจับตาและมีส่วนร่วมในการกำหนดทิศทางของเทคโนโลยีนี้จึงเป็นสิ่งจำเป็น เพื่อให้แน่ใจว่านวัตกรรมจะนำมาซึ่งความยุติธรรมที่เท่าเทียม ไม่ใช่ความเหลื่อมล้ำที่ลึกซึ้งกว่าเดิม