AI สร้างนักการเมืองปลอม! หาเสียงถึงบ้านคุณ

- ภาพรวมของเทคโนโลยี AI กับการเมืองยุคใหม่

- เทคโนโลยี AI กับการเมือง: เมื่อเส้นแบ่งความจริงพร่าเลือน

- กรณีศึกษาจากทั่วโลก: การใช้ AI แทรกแซงการเลือกตั้ง

- VoterAI และโฆษณาการเมืองเฉพาะบุคคล: กลยุทธ์ใหม่ที่น่ากังวล

- เปรียบเทียบเทคนิคการสร้างข่าวปลอมเลือกตั้งด้วย AI

- สถานการณ์ในประเทศไทยและความท้าทายในอนาคต

- แนวทางการรับมือและป้องกันผลกระทบ

- สรุป: อนาคตประชาธิปไตยในยุค AI

เทคโนโลยีปัญญาประดิษฐ์ (AI) กำลังปฏิวัติภูมิทัศน์ทางการเมืองทั่วโลก โดยเฉพาะอย่างยิ่งกับการเกิดขึ้นของ AI สร้างนักการเมืองปลอม! หาเสียงถึงบ้านคุณ ซึ่งไม่ใช่เรื่องไกลตัวอีกต่อไป แต่เป็นความจริงที่กำลังก่อให้เกิดความท้าทายต่อระบอบประชาธิปไตยและความน่าเชื่อถือของข้อมูลข่าวสาร การใช้ระบบอย่าง VoterAI เพื่อสร้างโฆษณาเลือกตั้งที่ปรับให้เข้ากับแต่ละบุคคลโดยเฉพาะ กำลังจุดชนวนให้เกิดวิกฤตความไว้วางใจและเปิดช่องให้เกิดการบงการความคิดของประชาชนในวงกว้าง

ภาพรวมของเทคโนโลยี AI กับการเมืองยุคใหม่

การมาถึงของ Generative AI ได้เปลี่ยนแปลงวิธีการสื่อสารและการหาเสียงทางการเมืองไปอย่างสิ้นเชิง ความสามารถในการสร้างเนื้อหาปลอมที่สมจริงได้จุดประกายให้เกิดประเด็นสำคัญที่ต้องพิจารณา ดังนี้:

- เทคโนโลยี AI ทำให้การสร้างภาพ วิดีโอ และเสียงปลอม (Deepfake) ของนักการเมืองเป็นเรื่องง่ายและแพร่หลายมากขึ้น ส่งผลกระทบโดยตรงต่อความน่าเชื่อถือของกระบวนการเลือกตั้ง

- กรณีศึกษาจากต่างประเทศ เช่น สหรัฐอเมริกาและเกาหลีใต้ แสดงให้เห็นถึงผลกระทบที่รุนแรงของเนื้อหาปลอมทางการเมือง ซึ่งสามารถสร้างความสับสนวุ่นวายและบั่นทอนความเชื่อมั่นของสาธารณชนได้

- ระบบที่เรียกว่า ‘VoterAI’ ใช้ข้อมูลส่วนบุคคลเพื่อสร้างโฆษณาที่ปรับแต่งมาโดยเฉพาะ ทำให้เกิดความกังวลเรื่องการบงการความคิดเห็นและละเมิดความเป็นส่วนตัว

- แม้ว่ายังไม่มีรายงานนักการเมือง AI ไปปรากฏตัวตามบ้านจริง แต่การโจมตีแบบเจาะจงผ่านช่องทางดิจิทัล เช่น การปลอมเสียงเพื่อติดต่อเจ้าหน้าที่รัฐระดับสูง ชี้ให้เห็นถึงศักยภาพในการหลอกลวงที่แนบเนียนและอันตรายยิ่งขึ้น

- รัฐบาลทั่วโลก รวมถึงประเทศไทย เริ่มตระหนักถึงภัยคุกคามและกำลังหามาตรการรับมือกับข่าวปลอมและเนื้อหาที่สร้างโดย AI ซึ่งเป็นความท้าทายสำคัญของสังคมยุคใหม่

เทคโนโลยี AI กับการเมือง: เมื่อเส้นแบ่งความจริงพร่าเลือน

สถานการณ์ที่ AI สร้างนักการเมืองปลอม! หาเสียงถึงบ้านคุณ ได้กลายเป็นหัวข้อสนทนาที่สำคัญในแวดวงการเมืองและเทคโนโลยี การพัฒนาอย่างก้าวกระโดดของปัญญาประดิษฐ์ โดยเฉพาะอย่างยิ่ง Generative AI ได้เปิดศักยภาพใหม่ๆ ในการสร้างสรรค์ แต่ในขณะเดียวกันก็ได้สร้างเครื่องมือที่ทรงพลังสำหรับการผลิตข้อมูลเท็จและการโฆษณาชวนเชื่อทางการเมืองอย่างที่ไม่เคยมีมาก่อน ปรากฏการณ์นี้กำลังท้าทายความสามารถของสังคมในการแยกแยะระหว่างความจริงกับสิ่งปรุงแต่ง ซึ่งอาจส่งผลกระทบอย่างลึกซึ้งต่อเสถียรภาพของระบอบประชาธิปไตยทั่วโลก

นิยามของนักการเมืองที่สร้างโดย AI

“นักการเมืองที่สร้างโดย AI” ไม่ได้หมายถึงหุ่นยนต์ที่เดินหาเสียง แต่หมายถึงตัวตนดิจิทัลที่ถูกสร้างขึ้นโดยเทคโนโลยีปัญญาประดิษฐ์ทั้งหมดหรือบางส่วน โดยอาศัยเทคนิคต่างๆ เช่น:

- Deepfake: การใช้ AI สร้างวิดีโอหรือภาพนิ่งที่สมจริง โดยนำใบหน้าของบุคคลหนึ่งไปสวมทับบนร่างกายของอีกบุคคลหนึ่ง ทำให้ดูเหมือนว่านักการเมืองคนนั้นกำลังพูดหรือทำในสิ่งที่ไม่ได้เกิดขึ้นจริง

- การสังเคราะห์เสียง (Voice Synthesis): เทคโนโลยีการโคลนเสียงที่สามารถสร้างเสียงพูดของบุคคลใดบุคคลหนึ่งได้อย่างแม่นยำจากข้อมูลเสียงเพียงเล็กน้อย ทำให้สามารถสร้างสุนทรพจน์หรือคำพูดปลอมที่ฟังดูน่าเชื่อถือได้

- การสร้างข้อความอัตโนมัติ (Automated Text Generation): การใช้โมเดลภาษาขนาดใหญ่ (LLMs) เพื่อเขียนบทความ สุนทรพจน์ หรือข้อความในโซเชียลมีเดียในนามของนักการเมือง โดยสามารถปรับเปลี่ยนน้ำเสียงและเนื้อหาให้สอดคล้องกับกลุ่มเป้าหมายแต่ละกลุ่มได้

เมื่อนำเทคโนโลยีเหล่านี้มารวมกันในระบบอย่าง ‘VoterAI’ จะทำให้เกิดเครื่องมือหาเสียงที่สามารถสร้างเนื้อหาที่ปรับให้เข้ากับผู้รับสารแต่ละคนได้อย่างสมบูรณ์แบบ ก่อให้เกิดอิทธิพลและการชักจูงในระดับที่น่ากังวล

ทำไมประเด็นนี้จึงสำคัญในยุคดิจิทัล

ความสำคัญของปัญหานี้หยั่งรากลึกในโครงสร้างพื้นฐานของสังคมประชาธิปไตย ซึ่งต้องอาศัยข้อมูลที่ถูกต้องและน่าเชื่อถือเพื่อให้ประชาชนสามารถตัดสินใจได้อย่างมีเหตุผล การแพร่กระจายของเนื้อหาการเมืองที่สร้างโดย AI ก่อให้เกิดผลกระทบหลายมิติ:

- การกัดกร่อนความไว้วางใจ: เมื่อประชาชนไม่สามารถแน่ใจได้ว่าสิ่งที่เห็นหรือได้ยินจากนักการเมืองเป็นเรื่องจริง ความไว้วางใจต่อสถาบันทางการเมืองและสื่อมวลชนก็จะลดลงอย่างรวดเร็ว

- การบงการการเลือกตั้ง: กลุ่มผู้ไม่หวังดีสามารถใช้เนื้อหาปลอมเพื่อทำลายชื่อเสียงของคู่แข่งทางการเมือง สร้างความแตกแยกในสังคม หรือเผยแพร่นโยบายที่บิดเบือน เพื่อโน้มน้าวผลการเลือกตั้ง

- วิกฤตข้อมูลข่าวสาร (Information Crisis): สังคมอาจเข้าสู่ภาวะที่เรียกว่า “Liar’s Dividend” ซึ่งนักการเมืองตัวจริงสามารถปฏิเสธความผิดของตนเองได้ง่ายขึ้นโดยอ้างว่าหลักฐานต่างๆ เป็นเพียง Deepfake ที่ถูกสร้างขึ้นมาเพื่อใส่ร้าย

- การคุกคามความมั่นคง: ดังที่เห็นจากกรณีการปลอมตัวตนเจ้าหน้าที่ระดับสูง เทคโนโลยีนี้สามารถถูกนำไปใช้เพื่อจารกรรมข้อมูลที่ละเอียดอ่อน หรือสร้างความขัดแย้งระหว่างประเทศได้

ในยุคที่เส้นแบ่งระหว่างความจริงกับเรื่องแต่งเลือนลางลง ความสามารถในการคิดวิเคราะห์และตรวจสอบข้อมูลของพลเมืองจึงกลายเป็นเกราะป้องกันที่สำคัญที่สุดของระบอบประชาธิปไตย

กรณีศึกษาจากทั่วโลก: การใช้ AI แทรกแซงการเลือกตั้ง

ภัยคุกคามจากการใช้ AI ในทางการเมืองไม่ใช่เพียงทฤษฎี แต่ได้เกิดขึ้นจริงแล้วในหลายประเทศทั่วโลก กรณีศึกษาเหล่านี้เป็นเครื่องยืนยันถึงอานุภาพและความอันตรายของเทคโนโลยีดังกล่าวในการแทรกแซงกระบวนการประชาธิปไตย

การเลือกตั้งสหรัฐฯ: สนามรบแห่งข้อมูลเท็จ

การเลือกตั้งในสหรัฐอเมริกาปี 2024 ถูกบันทึกว่าเป็นครั้งแรกที่มีการใช้ Generative AI ในการหาเสียงอย่างกว้างขวางและส่งผลกระทบอย่างชัดเจน มีการสร้างเนื้อหาปลอมหลากหลายรูปแบบ ตั้งแต่ภาพถ่ายที่บิดเบือนเหตุการณ์ไปจนถึงวิดีโอและคลิปเสียงที่สร้างขึ้นเพื่อโจมตีคู่แข่งทางการเมือง เนื้อหาเหล่านี้แพร่กระจายอย่างรวดเร็วบนโซเชียลมีเดีย ทำให้ผู้มีสิทธิ์เลือกตั้งเกิดความสับสนและยากที่จะแยกแยะข้อมูลจริงออกจากข้อมูลเท็จ สถานการณ์ดังกล่าวไม่เพียงแต่ส่งผลต่อภาพลักษณ์และความน่าเชื่อถือของผู้สมัคร แต่ยังบั่นทอนความเชื่อมั่นในกระบวนการเลือกตั้งโดยรวมอีกด้วย

เกาหลีใต้กับวิกฤต Deepfake ทางการเมือง

เกาหลีใต้เป็นอีกหนึ่งประเทศที่เผชิญกับความปั่นป่วนจากการใช้ Deepfake ทางการเมืองอย่างรุนแรง กรณีที่โดดเด่นคือการสร้างวิดีโอปลอมของประธานาธิบดี ซึ่งกล่าวหาว่าตัวเขามีส่วนพัวพันกับการทุจริตคอร์รัปชัน วิดีโอดังกล่าวถูกสร้างขึ้นอย่างแนบเนียนและเผยแพร่ไปทั่วสังคมออนไลน์ ก่อให้เกิดความไม่พอใจและความไม่เชื่อถือในหมู่ประชาชนอย่างกว้างขวาง เหตุการณ์นี้ได้จุดประกายให้เกิดการถกเถียงครั้งใหญ่เกี่ยวกับความจำเป็นในการออกกฎหมายเพื่อควบคุมการใช้เทคโนโลยี AI และป้องกันไม่ให้เกิดการแทรกแซงทางการเมืองในลักษณะเดียวกันนี้อีกในอนาคต

การปลอมตัวตนเจ้าหน้าที่ระดับสูงเพื่อจารกรรมข้อมูล

นอกเหนือจากการแทรกแซงการเลือกตั้ง เทคโนโลยี AI ยังถูกใช้เป็นเครื่องมือในการจารกรรมข้อมูลและความมั่นคงระดับชาติ โดยล่าสุดในสหรัฐอเมริกา กำลังมีการสืบสวนกรณีที่บุคคลไม่ทราบที่มาใช้ AI สังเคราะห์เสียงและสร้างตัวตนปลอมเป็นรัฐมนตรีว่าการกระทรวงการต่างประเทศ เพื่อพยายามติดต่อกับเจ้าหน้าที่รัฐบาลและรัฐมนตรีต่างชาติอย่างน้อย 3 คน ผ่านแอปพลิเคชันสนทนาอย่าง Signal แม้ว่าความพยายามดังกล่าวจะไม่ประสบความสำเร็จในการล้วงข้อมูล แต่เหตุการณ์นี้แสดงให้เห็นถึงระดับความซับซ้อนของภัยคุกคาม ซึ่งสามารถเลียนแบบบุคคลสำคัญเพื่อเข้าถึงข้อมูลลับหรือสร้างความเสียหายต่อความสัมพันธ์ระหว่างประเทศได้

VoterAI และโฆษณาการเมืองเฉพาะบุคคล: กลยุทธ์ใหม่ที่น่ากังวล

แนวคิดเรื่อง “AI สร้างนักการเมืองปลอม” ได้พัฒนาไปอีกขั้นสู่การสร้างแคมเปญโฆษณาที่ออกแบบมาเพื่อโน้มน้าวจิตใจผู้คนในระดับปัจเจกบุคคล ผ่านระบบที่เรียกว่า VoterAI ซึ่งเป็นตัวแทนของกลยุทธ์การหาเสียงยุคใหม่ที่อาศัยข้อมูลขนาดใหญ่และปัญญาประดิษฐ์เป็นอาวุธสำคัญ

VoterAI คืออะไรและทำงานอย่างไร

VoterAI คือชื่อเรียกเชิงแนวคิดของระบบหรือแพลตฟอร์มที่ใช้ปัญญาประดิษฐ์เพื่อสร้างและเผยแพร่โฆษณาทางการเมืองแบบอัตโนมัติและปรับแต่งให้เข้ากับแต่ละบุคคล (Hyper-Personalized) กระบวนการทำงานของมันแบ่งได้เป็นขั้นตอนหลักๆ ดังนี้:

- การรวบรวมข้อมูล: ระบบจะทำการรวบรวมข้อมูลส่วนบุคคลของผู้มีสิทธิ์เลือกตั้งจากแหล่งต่างๆ ไม่ว่าจะเป็นข้อมูลประชากร, ประวัติการท่องเว็บ, กิจกรรมบนโซเชียลมีเดีย, หรือข้อมูลที่ซื้อมาจากบริษัทนายหน้าข้อมูล (Data Brokers)

- การวิเคราะห์และแบ่งกลุ่ม: AI จะวิเคราะห์ข้อมูลมหาศาลเหล่านี้เพื่อทำความเข้าใจโปรไฟล์ทางจิตวิทยา (Psychographic Profile) ของแต่ละบุคคล เช่น ความเชื่อ, ความกลัว, ความหวัง, และจุดยืนทางการเมือง จากนั้นจะทำการแบ่งกลุ่มผู้มีสิทธิ์เลือกตั้งออกเป็นกลุ่มย่อยๆ (Micro-Targeting)

- การสร้างเนื้อหาอัตโนมัติ: จากการวิเคราะห์โปรไฟล์ ระบบจะใช้ Generative AI เพื่อสร้างเนื้อหาโฆษณาที่แตกต่างกันสำหรับแต่ละกลุ่มเป้าหมาย เช่น สร้างวิดีโอ Deepfake ของนักการเมืองที่พูดถึงปัญหาที่คนกลุ่มนั้นให้ความสำคัญโดยเฉพาะ หรือสร้างข้อความที่กระตุ้นอารมณ์ความรู้สึกที่สอดคล้องกับความเชื่อของพวกเขา

- การเผยแพร่แบบเจาะจง: เนื้อหาที่สร้างขึ้นจะถูกส่งไปยังเป้าหมายผ่านช่องทางโฆษณาดิจิทัลต่างๆ ทำให้ผู้รับสารแต่ละคนได้รับข้อความที่ดูเหมือนจะ “พูดกับพวกเขาโดยตรง”

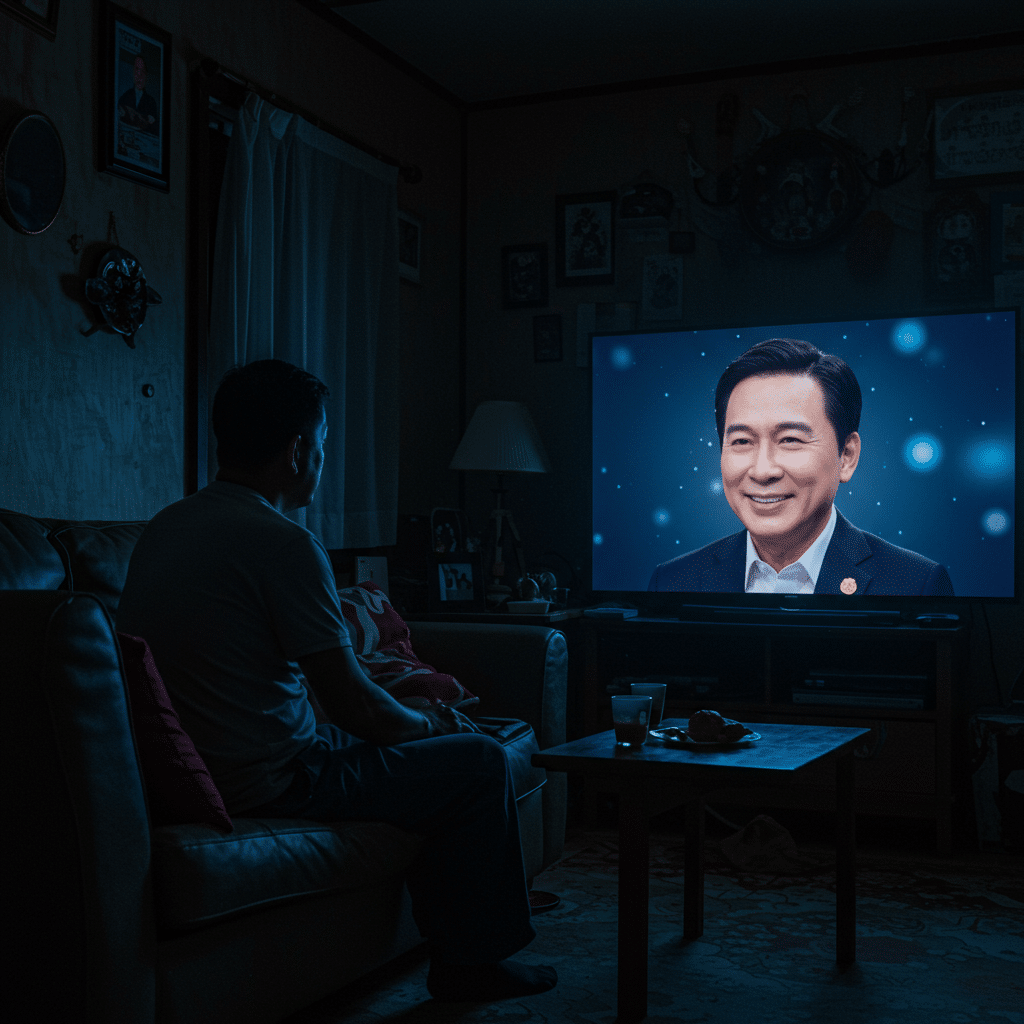

จากข้อมูลส่วนตัวสู่การบงการความคิด

อันตรายที่แท้จริงของระบบอย่าง VoterAI คือความสามารถในการเปลี่ยนข้อมูลส่วนตัวให้กลายเป็นเครื่องมือในการบงการความคิดเห็น การที่ผู้คนได้รับสารที่ออกแบบมาเพื่อกระตุ้นอคติหรือความกลัวส่วนตัวของพวกเขาโดยเฉพาะ อาจทำให้เกิดการตัดสินใจที่ไม่ได้อยู่บนพื้นฐานของเหตุผลหรือข้อเท็จจริงอย่างรอบด้าน นี่คือการนำแนวคิด “หาเสียงถึงบ้านคุณ” มาทำให้เป็นจริงในโลกดิจิทัล โดย “นักการเมือง AI” จะปรากฏตัวบนหน้าจออุปกรณ์ส่วนตัว พูดในสิ่งที่ผู้รับสารอยากได้ยิน หรือสิ่งที่ทำให้พวกเขากลัว ซึ่งมีพลังในการโน้มน้าวสูงกว่าการหาเสียงแบบดั้งเดิมอย่างมหาศาล และยังสร้างความท้าทายอย่างยิ่งต่อความเป็นส่วนตัวและเสรีภาพในการตัดสินใจของพลเมือง

เปรียบเทียบเทคนิคการสร้างข่าวปลอมเลือกตั้งด้วย AI

เพื่อทำความเข้าใจภัยคุกคามจาก AI ในการเมืองให้ชัดเจนยิ่งขึ้น การเปรียบเทียบเทคนิคต่างๆ ที่ถูกนำมาใช้จะช่วยให้เห็นถึงลักษณะเฉพาะและระดับความรุนแรงของแต่ละวิธี

| เทคนิค | คำอธิบาย | ระดับผลกระทบและความเสี่ยง |

|---|---|---|

| วิดีโอ Deepfake | การสร้างวิดีโอสังเคราะห์ที่นำใบหน้าของบุคคลหนึ่งไปแทนที่อีกคนหนึ่ง ทำให้ดูเหมือนนักการเมืองกำลังพูดหรือกระทำในสิ่งที่ไม่ได้ทำจริง | สูงมาก: มีผลกระทบทางสายตาที่น่าเชื่อถือสูง สามารถสร้างความเข้าใจผิดได้อย่างรวดเร็วและเป็นวงกว้าง ยากต่อการตรวจสอบสำหรับคนทั่วไป |

| การโคลนเสียงด้วย AI | การสังเคราะห์เสียงพูดของบุคคลใดบุคคลหนึ่งขึ้นมาใหม่ ทำให้สามารถสร้างคลิปเสียงปลอมที่พูดข้อความใดก็ได้ด้วยน้ำเสียงที่เหมือนจริง | สูง: มีประสิทธิภาพในการหลอกลวงผ่านการสื่อสารทางโทรศัพท์หรือข้อความเสียง สามารถใช้ปลอมตัวเป็นบุคคลสำคัญเพื่อสั่งการหรือล้วงข้อมูลลับได้ |

| โฆษณาสร้างสรรค์เฉพาะบุคคล (VoterAI) | การใช้ข้อมูลส่วนบุคคลเพื่อสร้างโฆษณา (ภาพ, ข้อความ, วิดีโอ) ที่ปรับแต่งเนื้อหาและสุนทรียศาสตร์ให้ตรงกับโปรไฟล์ทางจิตวิทยาของผู้รับสารแต่ละราย | สูงมาก: เป็นการโจมตีเชิงจิตวิทยาที่แนบเนียนและตรวจจับได้ยาก สามารถบงการความคิดเห็นในระดับบุคคลโดยที่เป้าหมายอาจไม่รู้ตัว กัดกร่อนกระบวนการตัดสินใจอย่างเป็นเหตุเป็นผล |

สถานการณ์ในประเทศไทยและความท้าทายในอนาคต

แม้ว่ากรณีศึกษาที่รุนแรงส่วนใหญ่จะเกิดขึ้นในต่างประเทศ แต่ประเทศไทยก็ไม่ได้ปลอดภัยจากภัยคุกคามของ AI ทางการเมือง การตระหนักรู้และเตรียมความพร้อมจึงเป็นสิ่งจำเป็นอย่างยิ่ง

การตื่นตัวของภาครัฐต่อภัยคุกคามจาก AI

หน่วยงานภาครัฐของไทยได้เริ่มแสดงความกังวลและมีการเคลื่อนไหวต่อปัญหาดังกล่าว มีการออกประกาศเตือนประชาชนให้ระมัดระวังคลิปวิดีโอที่สร้างโดย AI ซึ่งมักใช้ภาพลักษณ์ของบุคคลที่มีชื่อเสียงหรือชาวต่างชาติเพื่อหลอกลวงหรือสร้างความเข้าใจผิดบนโซเชียลมีเดีย นอกจากนี้ ยังมีการขอความร่วมมือจากประชาชนให้ช่วยกันรายงานเนื้อหาที่น่าสงสัย เพื่อสกัดกั้นการแพร่กระจายของข่าวปลอมเลือกตั้งและการปั่นกระแสในสังคม การตื่นตัวนี้เป็นสัญญาณที่ดี แต่ยังคงต้องการมาตรการเชิงรุกและกรอบกฎหมายที่ชัดเจนเพื่อรับมือกับความท้าทายที่ซับซ้อนยิ่งขึ้นในอนาคต

ความเป็นไปได้ที่เทคโนโลยีนี้จะถูกใช้ในบริบทไทย

ในบริบทการเมืองไทย เทคโนโลยี AI สามารถถูกนำมาใช้ได้ในหลายรูปแบบ แม้อาจจะยังไม่ถึงขั้นระบบ VoterAI ที่ซับซ้อน แต่การสร้าง Deepfake ของนักการเมืองคนสำคัญเพื่อทำลายชื่อเสียงในช่วงใกล้เลือกตั้งนั้นมีความเป็นไปได้สูงมาก เนื้อหาปลอมเหล่านี้สามารถแพร่กระจายอย่างรวดเร็วผ่านแอปพลิเคชันยอดนิยมอย่าง LINE, Facebook และ TikTok ซึ่งเป็นช่องทางหลักในการเสพข่าวสารของคนไทยจำนวนมาก

สถานการณ์ “AI สร้างนักการเมืองปลอม! หาเสียงถึงบ้านคุณ” ในประเทศไทยอาจไม่ได้หมายถึงการเผชิญหน้ากันจริงๆ แต่เป็นการรุกล้ำเข้ามาในพื้นที่ส่วนตัวผ่านหน้าจอสมาร์ทโฟน ด้วยข้อความและวิดีโอที่ออกแบบมาเพื่อโน้มน้าวใจโดยเฉพาะ ซึ่งอาจส่งผลต่อการตัดสินใจลงคะแนนเสียงและสร้างความแตกแยกในสังคมได้ไม่ต่างจากที่เกิดขึ้นในประเทศอื่นๆ

แนวทางการรับมือและป้องกันผลกระทบ

การต่อสู้กับข้อมูลเท็จที่สร้างโดย AI ต้องอาศัยความร่วมมือจากทุกภาคส่วน ตั้งแต่ประชาชนทั่วไปไปจนถึงผู้กำหนดนโยบายและบริษัทเทคโนโลยี

สำหรับประชาชนทั่วไป: การตรวจสอบข้อมูลเบื้องต้น

การสร้างภูมิคุ้มกันดิจิทัลเป็นสิ่งสำคัญที่สุด ประชาชนสามารถป้องกันตนเองได้โดย:

- ตั้งคำถามกับเนื้อหาที่น่าสงสัย: หากเนื้อหานั้นกระตุ้นอารมณ์รุนแรงเกินไป หรือดูดีเกินจริง ควรตั้งข้อสงสัยไว้ก่อน

- สังเกตความผิดปกติ: ในวิดีโอ Deepfake อาจมีการกะพริบตาที่ไม่เป็นธรรมชาติ, สีผิวที่ไม่สม่ำเสมอ, หรือการเคลื่อนไหวของริมฝีปากที่ไม่สอดคล้องกับเสียง

- ตรวจสอบแหล่งที่มา: ตรวจสอบว่าข่าวสารมาจากแหล่งข่าวที่น่าเชื่อถือหรือไม่ ลองค้นหาข้อมูลเดียวกันจากหลายๆ แหล่งเพื่อเปรียบเทียบ

- ชะลอการแชร์: ก่อนจะกดแชร์เนื้อหาทางการเมืองที่น่าตื่นเต้น ควรใช้เวลาตรวจสอบข้อมูลให้แน่ใจก่อน เพื่อไม่ให้ตนเองกลายเป็นส่วนหนึ่งของการเผยแพร่ข้อมูลเท็จ

สำหรับหน่วยงานกำกับดูแลและแพลตฟอร์ม

หน่วยงานภาครัฐและบริษัทเจ้าของแพลตฟอร์มโซเชียลมีเดียมีบทบาทสำคัญในการสร้างสภาพแวดล้อมข้อมูลที่ปลอดภัย มาตรการที่สามารถดำเนินการได้ ได้แก่:

- การออกกฎหมายที่ชัดเจน: กำหนดกรอบกฎหมายที่เอาผิดกับการสร้างและเผยแพร่เนื้อหา Deepfake ที่เป็นอันตรายทางการเมือง

- นโยบายการกำกับดูแลเนื้อหา: แพลตฟอร์มต้องมีนโยบายที่ชัดเจนและบังคับใช้อย่างจริงจังในการลบเนื้อหาปลอมที่อาจส่งผลกระทบต่อการเลือกตั้ง

- การใช้เทคโนโลยีตรวจจับ: พัฒนาและนำเครื่องมือ AI มาใช้เพื่อตรวจจับและระบุเนื้อหาที่สร้างโดย AI โดยอาจใช้เทคนิคเช่น การฝังลายน้ำดิจิทัล (Digital Watermarking) ที่มองไม่เห็น เพื่อให้สามารถตรวจสอบที่มาของเนื้อหาได้

- การส่งเสริมความร่วมมือ: สร้างเครือข่ายความร่วมมือระหว่างภาครัฐ, ภาคเอกชน, และองค์กร