แอปฯ เพื่อนใจ AI ทำข้อมูลรั่ว! แชตลับหลุดว่อนเน็ต

แอปฯ เพื่อนใจ AI ทำข้อมูลรั่ว! แชตลับหลุดว่อนเน็ต

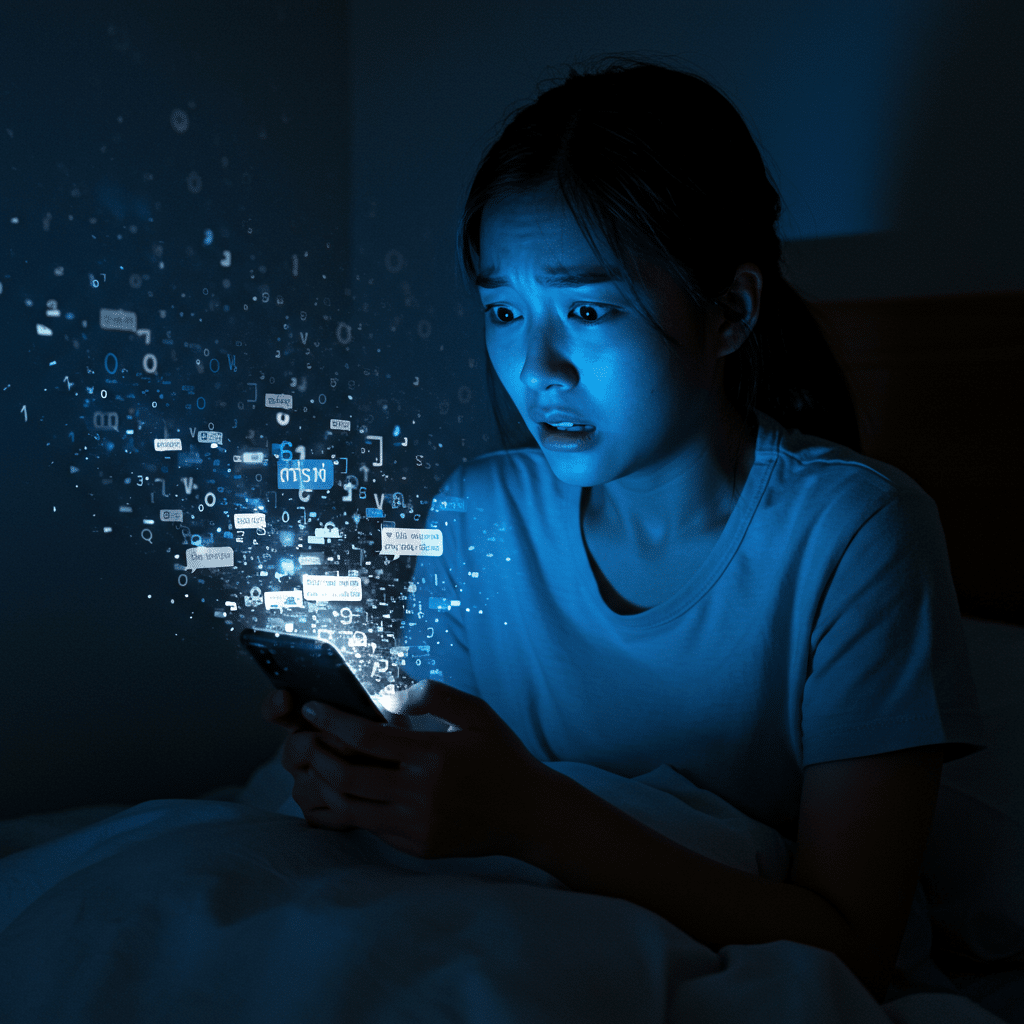

ในยุคที่เทคโนโลยีปัญญาประดิษฐ์ (AI) เข้ามามีบทบาทในชีวิตประจำวันมากขึ้น แอปพลิเคชันที่ทำหน้าที่เป็นเพื่อนใจหรือผู้ให้คำปรึกษาด้านสุขภาพจิตก็ได้รับความนิยมอย่างแพร่หลาย อย่างไรก็ตาม ความสะดวกสบายนี้กลับมาพร้อมกับความเสี่ยงด้านความปลอดภัยของข้อมูลที่หลายคนอาจคาดไม่ถึง

- ข้อมูลส่วนตัวและบทสนทนาที่ควรเป็นความลับจากแอปฯ เพื่อนใจ AI มีความเสี่ยงสูงที่จะรั่วไหลและถูกเผยแพร่สู่สาธารณะ

- สาเหตุสำคัญประการหนึ่งมาจากการตั้งค่าหรือฟีเจอร์ที่อนุญาตให้ผู้ใช้แชร์บทสนทนา ซึ่งอาจถูกเปิดใช้งานโดยไม่ตั้งใจ ทำให้ข้อมูลส่วนตัวถูกค้นหาเจอได้บนอินเทอร์เน็ต

- การหลีกเลี่ยงการให้ข้อมูลที่ละเอียดอ่อน 5 ประเภทแก่ AI เป็นสิ่งสำคัญอย่างยิ่ง ได้แก่ ข้อมูลส่วนบุคคล, ข้อมูลทางการเงิน, รหัสผ่าน, ข้อมูลสุขภาพ และความลับทางธุรกิจ

- ผู้ใช้งานสามารถลดความเสี่ยงได้ด้วยการตรวจสอบและปรับตั้งค่าความเป็นส่วนตัวในแอปพลิเคชันอย่างสม่ำเสมอ และใช้ความระมัดระวังในการเปิดเผยข้อมูล

- ผู้พัฒนาแอปพลิเคชันมีบทบาทสำคัญในการสร้างมาตรฐานความปลอดภัยและนโยบายความเป็นส่วนตัวที่รัดกุมเพื่อปกป้องผู้ใช้งาน

ปัญหา แอปฯ เพื่อนใจ AI ทำข้อมูลรั่ว! แชตลับหลุดว่อนเน็ต ได้กลายเป็นประเด็นสำคัญด้านความปลอดภัยไซเบอร์ที่ส่งผลกระทบในวงกว้าง แอปพลิเคชันเหล่านี้ซึ่งถูกออกแบบมาเพื่อเป็นพื้นที่ปลอดภัยสำหรับให้คำปรึกษาและระบายความรู้สึก กลับกลายเป็นดาบสองคมที่อาจเปิดเผยข้อมูลส่วนบุคคลที่ละเอียดอ่อนที่สุดของผู้ใช้งานสู่สาธารณะโดยไม่รู้ตัว เหตุการณ์ข้อมูลรั่วไหลจากแอปฯ ลักษณะนี้สร้างความกังวลอย่างมากต่อผู้ใช้งานนับล้านคนที่ไว้วางใจและแบ่งปันเรื่องราวส่วนตัวกับ AI โดยไม่คาดคิดว่าบทสนทนาเหล่านั้นอาจถูกค้นพบได้โดยบุคคลภายนอก

ความเสี่ยงที่ซ่อนอยู่เบื้องหลังความสะดวกสบายของ AI เพื่อนใจ

แอปพลิเคชัน AI ที่ทำหน้าที่เป็นเพื่อนคู่คิดหรือผู้ให้คำปรึกษาด้านสุขภาพจิต เช่น ‘ใจดี AI’ ได้รับการยอมรับอย่างรวดเร็วเนื่องจากความสะดวกในการเข้าถึง การรักษาความเป็นส่วนตัว (ในทางทฤษฎี) และการให้บริการตลอด 24 ชั่วโมง ผู้คนจำนวนมาก โดยเฉพาะกลุ่มคนรุ่นใหม่ รู้สึกสบายใจที่จะเปิดเผยความรู้สึกนึกคิด ปัญหา หรือความลับส่วนตัวกับ AI มากกว่ามนุษย์ด้วยกัน เนื่องจากเชื่อว่าจะไม่ถูกตัดสินและข้อมูลจะถูกเก็บเป็นความลับอย่างดี

อย่างไรก็ตาม สิ่งที่ตามมาคือความเสี่ยงที่มองไม่เห็น เมื่อข้อมูลบทสนทนาเหล่านี้รั่วไหลออกไป ผลกระทบที่เกิดขึ้นอาจรุนแรงกว่าการรั่วไหลของข้อมูลทั่วไป เพราะมันคือข้อมูลทางอารมณ์และความรู้สึกที่ละเอียดอ่อนอย่างยิ่ง การที่แชตลับหลุดสู่สาธารณะไม่เพียงแต่สร้างความอับอาย แต่ยังอาจนำไปสู่การถูกกลั่นแกล้งทางไซเบอร์ (Cyberbullying) การแบล็กเมล์ หรือการนำข้อมูลไปใช้ในทางที่ผิดเพื่อสร้างความเสียหายต่อชื่อเสียงและสถานะทางสังคมของผู้ใช้งานได้ สถานการณ์ดังกล่าวสั่นคลอนความไว้วางใจที่ผู้ใช้มีต่อเทคโนโลยี AI และกระตุ้นให้เกิดคำถามสำคัญเกี่ยวกับมาตรฐานความปลอดภัยของข้อมูลในแอปพลิเคชันประเภทนี้

การรั่วไหลของข้อมูลสุขภาพจิตไม่ได้เป็นเพียงการละเมิดความเป็นส่วนตัว แต่ยังเป็นการทำลายพื้นที่ปลอดภัยที่ผู้คนเคยไว้วางใจ ซึ่งอาจส่งผลกระทบต่อความกล้าที่จะขอความช่วยเหลือในอนาคต

สาเหตุหลัก: ทำไมแชตส่วนตัวถึงกลายเป็นข้อมูลสาธารณะ?

การที่ข้อมูลการสนทนาส่วนตัวกับ AI สามารถปรากฏบนผลการค้นหาของ Google หรือแพลตฟอร์มสาธารณะอื่น ๆ นั้น ไม่ได้เกิดจากการแฮกที่ซับซ้อนเสมอไป แต่บ่อยครั้งมีสาเหตุมาจากฟังก์ชันการทำงานของแอปพลิเคชันเอง และการขาดความเข้าใจของผู้ใช้งาน ซึ่งเป็นช่องโหว่สำคัญที่นำไปสู่การรั่วไหลของข้อมูล

ฟีเจอร์ “แชร์สู่สาธารณะ”: กับดักที่ผู้ใช้มองข้าม

หนึ่งในสาเหตุหลักที่ถูกค้นพบคือฟีเจอร์ที่ออกแบบมาเพื่อให้ผู้ใช้สามารถแชร์บทสนทนากับ AI ได้ แอปพลิเคชันบางตัวมีตัวเลือก เช่น “Make this chat discoverable” หรือ “แชร์บทสนทนานี้” ซึ่งเมื่อผู้ใช้กดเปิดใช้งานโดยตั้งใจหรือไม่ตั้งใจก็ตาม ระบบจะสร้างลิงก์สาธารณะสำหรับบทสนทนานั้น ๆ ขึ้นมาทันที ผลลัพธ์คือ บทสนทนาที่เคยเป็นส่วนตัวจะถูกแปลงสถานะเป็นข้อมูลสาธารณะที่ Search Engine สามารถเข้ามาเก็บข้อมูล (Index) และนำไปแสดงผลการค้นหาได้

ผู้ใช้หลายคนอาจเปิดใช้งานฟีเจอร์นี้โดยไม่ตระหนักถึงผลที่จะตามมา อาจเข้าใจผิดว่าเป็นการบันทึกบทสนทนาไว้ส่วนตัว หรืออาจกดไปโดยไม่ได้อ่านคำอธิบายอย่างละเอียด เมื่อบทสนทนาถูกจัดเก็บในฐานข้อมูลสาธารณะแล้ว การลบออกในภายหลังอาจเป็นเรื่องยากหรือเป็นไปไม่ได้เลย ทำให้ความลับที่เคยแบ่งปันกับ AI กลายเป็นร่องรอยดิจิทัลที่คงอยู่ถาวร

การขาดความโปร่งใสในนโยบายข้อมูล

อีกปัจจัยหนึ่งคือการที่ผู้พัฒนาแอปพลิเคชันอาจไม่ได้สื่อสารนโยบายความเป็นส่วนตัวและการจัดการข้อมูลให้ชัดเจนเพียงพอ ผู้ใช้งานมักจะกดยอมรับข้อตกลงและเงื่อนไขการใช้งาน (Terms and Conditions) โดยไม่ได้อ่านอย่างละเอียด ซึ่งในเอกสารเหล่านั้นอาจระบุถึงสิทธิ์ของบริษัทในการนำข้อมูลบทสนทนา (ในรูปแบบที่ไม่ระบุตัวตน) ไปใช้ในการฝึกฝนและพัฒนาโมเดล AI ต่อไป

แม้ว่าข้อมูลจะถูกทำให้ไม่ระบุตัวตน (Anonymized) แต่ก็ยังมีความเสี่ยงที่ข้อมูลบางส่วนอาจสามารถเชื่อมโยงกลับไปยังบุคคลได้หากมีรายละเอียดเฉพาะเจาะจงมากพอ การขาดความโปร่งใสในกระบวนการเหล่านี้ทำให้ผู้ใช้ไม่ทราบว่าข้อมูลของตนถูกนำไปใช้อย่างไร และมีความเสี่ยงที่จะถูกเปิดเผยมากน้อยเพียงใด

ข้อมูล 5 ประเภทที่ห้ามบอก AI โดยเด็ดขาด

เพื่อลดความเสี่ยงจากการรั่วไหลของข้อมูล ผู้เชี่ยวชาญด้านความปลอดภัยไซเบอร์ได้แนะนำอย่างจริงจังให้ผู้ใช้หลีกเลี่ยงการป้อนข้อมูลที่ละเอียดอ่อน 5 ประเภทต่อไปนี้ลงในระบบ AI แชตบอต ไม่ว่าจะเป็นแอปฯ เพื่อนใจหรือแอปพลิเคชัน AI อื่น ๆ ก็ตาม การตระหนักและปฏิบัติตามคำแนะนำนี้เป็นเกราะป้องกันด่านแรกที่สำคัญที่สุด

| ประเภทข้อมูล | คำอธิบายความเสี่ยง | ตัวอย่าง |

|---|---|---|

| ข้อมูลส่วนบุคคล (PII) | ข้อมูลที่สามารถใช้ระบุตัวตนได้โดยตรง หากรั่วไหลอาจถูกนำไปใช้สวมรอยหรือก่ออาชญากรรมอื่น ๆ | ชื่อ-นามสกุลเต็ม, หมายเลขบัตรประชาชน, ที่อยู่, เบอร์โทรศัพท์, วันเกิด, อีเมลส่วนตัว |

| ข้อมูลทางการเงิน | เป็นข้อมูลที่มีมูลค่าสูงสำหรับอาชญากรไซเบอร์ สามารถนำไปสู่การโจรกรรมทางการเงินได้โดยตรง | หมายเลขบัตรเครดิต/เดบิต, รหัส CVC, ข้อมูลบัญชีธนาคาร, ข้อมูลการลงทุน |

| รหัสผ่านและข้อมูลยืนยันตัวตน | หากข้อมูลเหล่านี้รั่วไหล อาจทำให้ผู้ไม่หวังดีสามารถเข้าถึงบัญชีออนไลน์อื่น ๆ ของผู้ใช้ได้ทั้งหมด | รหัสผ่านสำหรับบริการต่าง ๆ, คำตอบของคำถามเพื่อความปลอดภัย, รหัส PIN, รหัส OTP |

| ข้อมูลสุขภาพ | เป็นข้อมูลที่ละเอียดอ่อนอย่างยิ่ง การรั่วไหลอาจนำไปสู่การเลือกปฏิบัติ หรือการถูกเปิดโปงเรื่องส่วนตัว | ประวัติการรักษาพยาบาล, ผลการวินิจฉัยโรค, ข้อมูลการใช้ยา, รายละเอียดเกี่ยวกับสุขภาพจิต |

| ข้อมูลลับหรือความลับทางธุรกิจ | อาจสร้างความเสียหายร้ายแรงต่อองค์กรหรือโครงการที่กำลังดำเนินการอยู่ หากข้อมูลตกไปอยู่ในมือคู่แข่ง | ข้อมูลภายในบริษัท, แผนธุรกิจ, สูตรผลิตภัณฑ์, ข้อมูลโครงการที่ยังไม่เปิดตัว, ข้อมูลลูกค้า |

แนวทางป้องกันตนเองจากการรั่วไหลของข้อมูล

แม้ว่าความเสี่ยงจะดูน่ากังวล แต่ผู้ใช้งานก็สามารถ采取มาตรการเชิงรุกเพื่อปกป้องข้อมูลของตนเองได้ การสร้างเกราะป้องกันไม่ได้ขึ้นอยู่กับผู้พัฒนาเพียงฝ่ายเดียว แต่เริ่มต้นที่ความตระหนักรู้และการปรับเปลี่ยนพฤติกรรมการใช้งานของผู้ใช้เอง

การตั้งค่าความเป็นส่วนตัวในแอปพลิเคชัน

ขั้นตอนแรกที่ควรทำทันทีหลังติดตั้งแอปพลิเคชัน AI คือการเข้าไปสำรวจหน้า “การตั้งค่า” (Settings) และ “ความเป็นส่วนตัว” (Privacy) อย่างละเอียด ผู้ใช้ควรมองหาตัวเลือกที่เกี่ยวข้องกับการแชร์ข้อมูลและปิดการใช้งานที่ไม่จำเป็นทั้งหมด ตัวอย่างเช่น:

- ปิดการบันทึกประวัติการสนทนา: แอปฯ AI ชั้นนำหลายตัวมีตัวเลือกให้ปิดการบันทึกประวัติการแชต ซึ่งจะช่วยลดโอกาสที่ข้อมูลจะถูกนำไปใช้เทรนโมเดล AI หรือถูกเก็บไว้บนเซิร์ฟเวอร์อย่างถาวร

- ปฏิเสธการนำข้อมูลไปใช้พัฒนา AI: มองหาตัวเลือกที่อนุญาตให้ผู้ใช้ปฏิเสธ (Opt-out) การนำข้อมูลบทสนทนาไปใช้ในการวิจัยและพัฒนาผลิตภัณฑ์

- ตรวจสอบฟีเจอร์การแชร์: ตรวจสอบให้แน่ใจว่าไม่มีฟีเจอร์การแชร์สู่สาธารณะหรือ “Discoverable” ใด ๆ ถูกเปิดใช้งานอยู่ และทำความเข้าใจวิธีการทำงานของมันก่อนตัดสินใจใช้งาน

สร้างความตระหนักรู้: คิดก่อนพิมพ์

นอกเหนือจากการตั้งค่าทางเทคนิคแล้ว การปรับเปลี่ยนทัศนคติและพฤติกรรมการใช้งานก็เป็นสิ่งสำคัญอย่างยิ่ง ควรปฏิบัติต่อบทสนทนากับ AI ด้วยความระมัดระวังเสมอ และพึงระลึกไว้ว่าไม่มีระบบดิจิทัลใดที่ปลอดภัย 100%

ก่อนที่จะพิมพ์ข้อมูลส่วนตัวใด ๆ ลงไป ให้ตั้งคำถามกับตัวเองเสมอว่า “จะเกิดอะไรขึ้นหากข้อมูลนี้รั่วไหลสู่สาธารณะ” แนวคิดนี้จะช่วยให้ผู้ใช้ประเมินความเสี่ยงและตัดสินใจได้อย่างรอบคอบมากขึ้นว่าจะเปิดเผยข้อมูลในระดับใด หลีกเลี่ยงการระบุรายละเอียดที่สามารถเชื่อมโยงกลับมายังตัวตนได้ เช่น ชื่อบุคคลจริง สถานที่ทำงาน หรือเหตุการณ์เฉพาะที่เกิดขึ้นในชีวิตจริง การใช้ AI เพื่อระบายความรู้สึกหรือขอคำปรึกษาทั่วไปยังคงสามารถทำได้ แต่ควรทำในลักษณะที่ไม่เปิดเผยข้อมูลที่ละเอียดอ่อนจนเกินไป

บทบาทและความรับผิดชอบของผู้พัฒนาแอปพลิเคชัน

ท้ายที่สุดแล้ว ความรับผิดชอบในการปกป้องข้อมูลผู้ใช้ไม่ได้อยู่ที่ผู้ใช้งานเพียงฝ่ายเดียว แต่เป็นหน้าที่โดยตรงของผู้พัฒนาแอปพลิเคชันที่จะต้องสร้างผลิตภัณฑ์ที่มีความปลอดภัยและน่าเชื่อถือ บริษัทผู้พัฒนาจำเป็นต้องให้ความสำคัญกับหลักการ “Privacy by Design” ซึ่งหมายถึงการออกแบบระบบโดยคำนึงถึงความเป็นส่วนตัวของผู้ใช้เป็นอันดับแรกตั้งแต่ขั้นตอนการพัฒนา ไม่ใช่การนำมาแก้ไขในภายหลัง

ผู้พัฒนาควรมีมาตรการที่ชัดเจนและรัดกุม เช่น การเข้ารหัสข้อมูลทั้งในระหว่างการส่งและเมื่อจัดเก็บ (Encryption at rest and in transit), การมีนโยบายความเป็นส่วนตัวที่โปร่งใสและเข้าใจง่าย, และการออกแบบ User Interface (UI) ที่ไม่ชี้นำให้ผู้ใช้เปิดเผยข้อมูลโดยไม่จำเป็น โดยเฉพาะฟีเจอร์ที่เกี่ยวข้องกับการแชร์ข้อมูล ควรมีการแจ้งเตือนและขอคำยืนยันที่ชัดเจนถึงผลที่จะตามมา เพื่อให้แน่ใจว่าผู้ใช้เข้าใจความเสี่ยงก่อนตัดสินใจอย่างแท้จริง การสร้างความไว้วางใจในระยะยาวต้องอาศัยความซื่อสัตย์และความรับผิดชอบของผู้ให้บริการเทคโนโลยีเป็นสำคัญ

บทสรุป: ก้าวต่อไปอย่างปลอดภัยในยุค AI

เหตุการณ์ข้อมูลรั่วไหลจากแอปพลิเคชันเพื่อนใจ AI เป็นเครื่องเตือนใจที่สำคัญว่าเทคโนโลยีที่มอบความสะดวกสบายและเป็นที่พึ่งทางใจนั้นมาพร้อมกับความเสี่ยงด้านความปลอดภัยที่ต้องจัดการอย่างจริงจัง การที่แชตลับซึ่งเต็มไปด้วยข้อมูลส่วนบุคคลที่ละเอียดอ่อนสามารถหลุดรอดไปสู่โลกออนไลน์ได้นั้น เกิดจากทั้งช่องโหว่ในตัวแอปพลิเคชันเอง เช่น ฟีเจอร์การแชร์สู่สาธารณะ และการขาดความตระหนักรู้ของผู้ใช้งาน

เพื่อก้าวต่อไปอย่างปลอดภัยในยุค AI จำเป็นต้องอาศัยความร่วมมือจากทุกฝ่าย ผู้ใช้งานต้องเพิ่มความระมัดระวังในการให้ข้อมูล, ศึกษาและปรับตั้งค่าความเป็นส่วนตัวอย่างสม่ำเสมอ, และหลีกเลี่ยงการเปิดเผยข้อมูลที่สำคัญ 5 ประเภทโดยเด็ดขาด ในขณะเดียวกัน ผู้พัฒนาแอปพลิเคชันก็มีหน้าที่รับผิดชอบในการออกแบบระบบที่ปลอดภัย, โปร่งใส และปกป้องความเป็นส่วนตัวของผู้ใช้เป็นหัวใจสำคัญ การสร้างสมดุลระหว่างนวัตกรรมทางเทคโนโลยีกับการคุ้มครองข้อมูลส่วนบุคคล คือความท้าทายที่จะกำหนดอนาคตของความสัมพันธ์ระหว่างมนุษย์และปัญญาประดิษฐ์