ระวัง! AI Deepfake เสียงปลอมโทรลวง ดูดเงินเกลี้ยงบัญชี

ระวัง! AI Deepfake เสียงปลอมโทรลวง ดูดเงินเกลี้ยงบัญชี

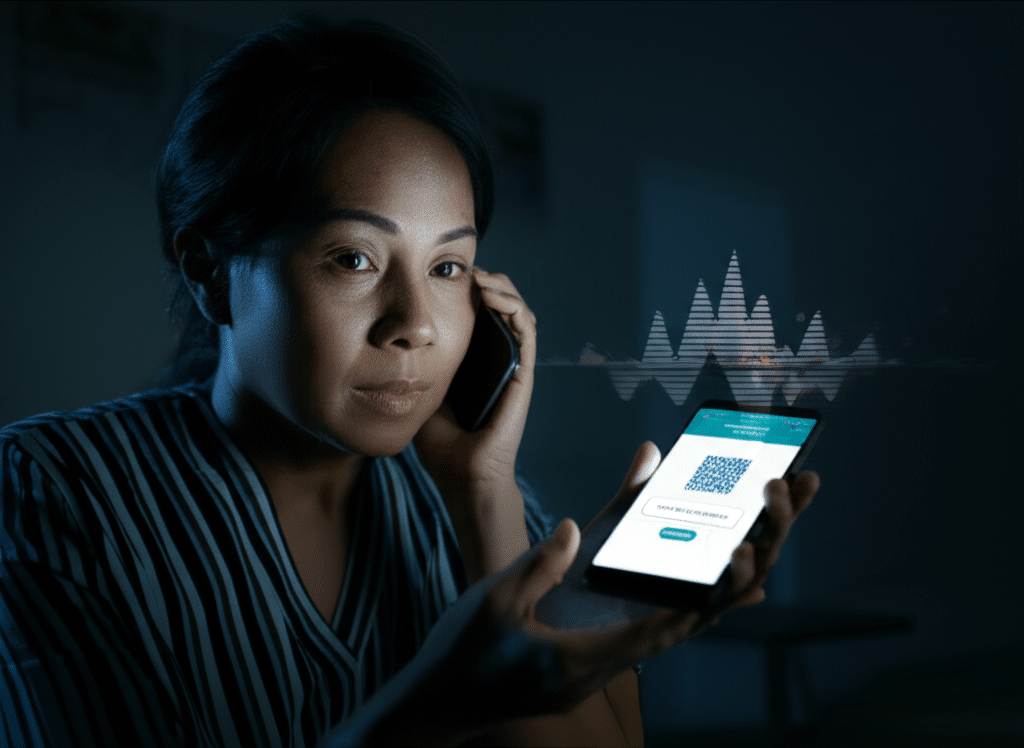

เทคโนโลยีปัญญาประดิษฐ์ (AI) ได้พัฒนาไปอย่างรวดเร็ว และในขณะเดียวกันก็เปิดช่องทางให้เกิดอาชญากรรมไซเบอร์รูปแบบใหม่ที่ซับซ้อนและน่ากังวลมากยิ่งขึ้น หนึ่งในนั้นคือการใช้ AI Deepfake เพื่อสร้างเสียงปลอมเลียนแบบบุคคลใกล้ชิดเพื่อหลอกลวงทางการเงิน

ประเด็นสำคัญที่ต้องจับตา

- มิจฉาชีพใช้เทคโนโลยี AI Deepfake สร้างเสียงปลอมของบุคคลที่น่าเชื่อถือ เช่น ญาติสนิท หรือผู้บังคับบัญชา เพื่อโทรศัพท์มาหลอกลวงให้โอนเงิน

- กลยุทธ์หลักคือการสร้างสถานการณ์ฉุกเฉินและเร่งด่วน เพื่อกดดันให้เหยื่อไม่มีเวลาไตร่ตรองและตัดสินใจโอนเงินอย่างรวดเร็ว

- ความเสียหายทางการเงินจากอาชญากรรมที่ใช้ Deepfake ทั่วโลกกำลังเพิ่มสูงขึ้นในอัตราที่น่าตกใจ บ่งชี้ถึงแนวโน้มภัยคุกคามที่รุนแรงขึ้นในอนาคต

- การตรวจสอบและยืนยันตัวตนของผู้โทรผ่านช่องทางอื่นที่เชื่อถือได้ เช่น การโทรกลับไปยังเบอร์โทรศัพท์ที่บันทึกไว้ คือมาตรการป้องกันที่ดีที่สุด

- การยืนยันตัวตนด้วยเสียงเพียงอย่างเดียวไม่ปลอดภัยอีกต่อไป องค์กรและบุคคลทั่วไปจำเป็นต้องปรับตัวและเพิ่มความระมัดระวังให้มากขึ้น

ภัยคุกคามจาก AI Deepfake เสียงปลอมโทรลวง ดูดเงินเกลี้ยงบัญชี เป็นอาชญากรรมไซเบอร์รูปแบบใหม่ที่ใช้ประโยชน์จากเทคโนโลยีปัญญาประดิษฐ์ขั้นสูงเพื่อสร้างการหลอกลวงที่แนบเนียนอย่างที่ไม่เคยมีมาก่อน มิจฉาชีพสามารถสังเคราะห์เสียงของบุคคลใดก็ได้ ไม่ว่าจะเป็นสมาชิกในครอบครัว เพื่อนสนิท หรือเจ้านาย เพื่อสร้างเรื่องราวหลอกลวงที่น่าเชื่อถือและกดดันให้เหยื่อโอนเงินหรือเปิดเผยข้อมูลทางการเงินที่สำคัญ การมาถึงของเทคโนโลยีนี้ได้ยกระดับความอันตรายของแก๊งคอลเซ็นเตอร์แบบดั้งเดิมไปอีกขั้น ทำให้การแยกแยะระหว่างการสนทนาจริงและการหลอกลวงทำได้ยากขึ้นอย่างยิ่ง

ความสำคัญของปัญหานี้อยู่ที่ผลกระทบโดยตรงต่อความมั่นคงทางการเงินและความปลอดภัยในชีวิตประจำวันของประชาชนทุกคน บุคคลทุกกลุ่มวัยและทุกสาขาอาชีพล้วนมีความเสี่ยงที่จะตกเป็นเหยื่อ เนื่องจากกลโกงนี้โจมตีจุดอ่อนทางจิตวิทยาของมนุษย์ คือความไว้วางใจและความห่วงใยที่มีต่อคนใกล้ชิด เมื่อเทคโนโลยีสามารถเลียนแบบเสียงได้อย่างสมจริง การป้องกันตัวเองจึงไม่ได้อาศัยเพียงแค่การสังเกตน้ำเสียงที่ผิดปกติเหมือนในอดีตอีกต่อไป แต่จำเป็นต้องอาศัยความตระหนักรู้ ความรอบคอบ และกระบวนการตรวจสอบที่เข้มงวดกว่าเดิมเพื่อป้องกันความสูญเสียที่อาจเกิดขึ้น

ทำความเข้าใจภัยคุกคาม AI Deepfake เสียงปลอม

ภัยคุกคามจากการใช้เสียงปลอมที่สร้างโดย AI หรือที่เรียกว่า “AI Deepfake Voice” กำลังกลายเป็นเครื่องมือสำคัญของอาชญากรไซเบอร์ทั่วโลก เทคโนโลยีนี้ไม่ได้จำกัดอยู่แค่ในแวดวงภาพยนตร์หรือความบันเทิงอีกต่อไป แต่ได้ถูกนำมาใช้ในทางที่ผิดเพื่อสร้างความเสียหายทางการเงินและบ่อนทำลายความไว้วางใจในสังคม การทำความเข้าใจกลไกและวิธีการของมิจฉาชีพคือด่านแรกในการสร้างภูมิคุ้มกันให้แก่ตนเองและคนรอบข้าง

เทคโนโลยีเบื้องหลังเสียงปลอมที่แนบเนียน

เบื้องหลังเสียงปลอมที่สมจริงจนน่าตกใจคือเทคโนโลยีปัญญาประดิษฐ์ที่เรียกว่า Voice Cloning (การโคลนนิ่งเสียง) และ AI Voice Chatbot (แชทบอทเสียง) ระบบเหล่านี้ทำงานโดยการให้ AI วิเคราะห์ข้อมูลเสียงตัวอย่างจำนวนมากของบุคคลเป้าหมาย ไม่ว่าจะเป็นคลิปเสียงจากการสนทนา วิดีโอที่เผยแพร่บนโซเชียลมีเดีย หรือแม้แต่ข้อความเสียงสั้นๆ AI จะเรียนรู้ลักษณะเฉพาะของเสียงนั้นๆ เช่น ระดับเสียงสูงต่ำ จังหวะการพูด สำเนียง และลักษณะการเปล่งเสียงที่เป็นเอกลักษณ์

เมื่อ AI เรียนรู้และสร้างแบบจำลองเสียง (Voice Model) ของบุคคลเป้าหมายได้แล้ว มิจฉาชีพสามารถป้อนข้อความใดๆ เข้าไปในระบบเพื่อให้ AI สังเคราะห์เสียงพูดที่เหมือนกับเสียงของเจ้าของตัวจริงออกมาได้อย่างเป็นธรรมชาติและรวดเร็ว ความก้าวหน้าของเทคโนโลยีนี้ทำให้เสียงที่ได้มีความลื่นไหลและแสดงอารมณ์ได้ใกล้เคียงกับมนุษย์มาก จนแทบเป็นไปไม่ได้ที่จะแยกแยะด้วยการฟังเพียงอย่างเดียว

ความสามารถในการสร้างเสียงปลอมที่เหมือนจริงนี้ ทำให้การยืนยันตัวตนด้วยเสียงเพียงอย่างเดียวกลายเป็นมาตรการที่ไม่เพียงพอและมีความเสี่ยงสูงในยุคปัจจุบัน

กลโกงที่มิจฉาชีพใช้หลอกลวงเหยื่อ

มิจฉาชีพประยุกต์ใช้เทคโนโลยี AI Deepfake Voice ในการสร้างสถานการณ์หลอกลวงที่หลากหลาย โดยมีเป้าหมายหลักเพื่อสร้างความตื่นตระหนกและกดดันให้เหยื่อตัดสินใจโดยขาดความยั้งคิด รูปแบบกลโกงที่พบบ่อยมีดังนี้:

- การปลอมเป็นบุคคลใกล้ชิด: มิจฉาชีพจะโทรจากหมายเลขโทรศัพท์ที่ไม่คุ้นเคย แต่ใช้เสียงปลอมที่เลียนแบบญาติสนิท เพื่อน หรือคนรัก โดยอ้างว่ากำลังตกอยู่ในสถานการณ์ฉุกเฉิน เช่น ประสบอุบัติเหตุ ถูกจับกุม หรือต้องการเงินด่วนเพื่อรักษาพยาบาล

- การปลอมเป็นผู้มีอำนาจหรือบุคคลที่น่าเชื่อถือ: กลวิธีนี้มุ่งเป้าไปที่พนักงานในองค์กร โดยมิจฉาชีพจะปลอมเสียงเป็นผู้บริหารระดับสูงหรือเจ้านาย เพื่อสั่งการให้โอนเงินของบริษัทไปยังบัญชีที่เตรียมไว้โดยอ้างว่าเป็นเรื่องด่วนและเป็นความลับ

- การสร้างสถานการณ์กดดัน: หัวใจของกลโกงคือการสร้างความรู้สึกเร่งรีบและฉุกเฉิน เพื่อไม่ให้เหยื่อมีเวลาตรวจสอบข้อเท็จจริง มิจฉาชีพมักจะใช้คำพูดที่แสดงความตื่นตระหนก วิงวอน หรือแม้กระทั่งข่มขู่ เพื่อบีบคั้นทางอารมณ์

- การใช้ข้อมูลส่วนตัวประกอบการหลอกลวง: เพื่อเพิ่มความน่าเชื่อถือ มิจฉาชีพอาจนำข้อมูลส่วนตัวของเหยื่อหรือคนใกล้ชิดที่หาได้จากโซเชียลมีเดียมาใช้ประกอบการสนทนา ทำให้เรื่องราวที่สร้างขึ้นดูสมจริงยิ่งขึ้น

- การผสานกับ Deepfake วิดีโอ: ในบางกรณีที่ซับซ้อนขึ้น มิจฉาชีพอาจใช้ Deepfake วิดีโอควบคู่ไปกับเสียงปลอมในการสนทนาแบบวิดีโอคอล เพื่อสร้างหลักฐานปลอมที่แนบเนียนที่สุด เช่น ภาพผู้บริหารกำลังประชุมและสั่งงานผ่านวิดีโอ

ผลกระทบและแนวโน้มของอาชญากรรมไซเบอร์รูปแบบใหม่

การเพิ่มขึ้นของอาชญากรรมที่ใช้ AI Deepfake ไม่ใช่แค่ปัญหาที่เกิดขึ้นในบางพื้นที่ แต่เป็นปรากฏการณ์ระดับโลกที่ส่งผลกระทบอย่างรุนแรงต่อความมั่นคงทางการเงินและสร้างความท้าทายใหม่ให้กับระบบความปลอดภัยในทุกภาคส่วน ตัวเลขและข้อมูลจากหน่วยงานที่น่าเชื่อถือได้สะท้อนให้เห็นถึงแนวโน้มที่น่ากังวลและจำเป็นต้องมีการรับมืออย่างเร่งด่วน

สถิติความเสียหายที่เพิ่มขึ้นอย่างก้าวกระโดด

ข้อมูลจากรายงานของธนาคารโลก (World Bank) ได้ชี้ให้เห็นถึงสถานการณ์ที่น่าเป็นห่วง โดยระบุว่าอาชญากรรมที่ใช้เทคโนโลยี Deepfake ในการฉ้อโกงได้เพิ่มสูงขึ้นถึง 900% ในช่วงไม่กี่ปีที่ผ่านมา ตัวเลขดังกล่าวสะท้อนให้เห็นถึงการแพร่ระบาดของภัยคุกคามนี้อย่างรวดเร็วและการปรับตัวของกลุ่มมิจฉาชีพในการนำเทคโนโลยีใหม่ๆ มาใช้เป็นเครื่องมือ

ยิ่งไปกว่านั้น ยังมีการคาดการณ์ว่าภายในปี 2027 มูลค่าความเสียหายทางการเงินที่เกิดจากการฉ้อโกงด้วย Deepfake ทั่วโลกอาจพุ่งสูงถึง 40 พันล้านดอลลาร์สหรัฐ ซึ่งเป็นจำนวนมหาศาลที่ส่งผลกระทบไม่เพียงแค่ระดับบุคคล แต่ยังรวมถึงระดับองค์กรและเศรษฐกิจในภาพรวมด้วย แนวโน้มนี้บ่งชี้ว่าภัยคุกคามจาก AI Deepfake จะยังคงทวีความรุนแรงและซับซ้อนยิ่งขึ้นในอนาคตอันใกล้

ความท้าทายต่อระบบความปลอดภัยในปัจจุบัน

การมาถึงของ AI Deepfake Voice ได้สั่นคลอนรากฐานของมาตรการรักษาความปลอดภัยแบบดั้งเดิม โดยเฉพาะอย่างยิ่งระบบที่อาศัยการยืนยันตัวตนด้วยเสียง (Voice Biometrics) ซึ่งเคยถูกมองว่ามีความปลอดภัยสูง ในอดีต การใช้เสียงเพื่อเข้าถึงบัญชีธนาคารหรือบริการต่างๆ ถือเป็นวิธีที่สะดวกและปลอดภัย แต่เมื่อ AI สามารถเลียนแบบเสียงได้อย่างสมบูรณ์แบบ วิธีการนี้จึงไม่สามารถรับประกันความปลอดภัยได้อีกต่อไป

องค์กรต่างๆ โดยเฉพาะสถาบันการเงินและผู้ให้บริการแพลตฟอร์มดิจิทัล จำเป็นต้องทบทวนและพัฒนากระบวนการยืนยันตัวตนให้มีความรัดกุมมากยิ่งขึ้น การใช้การยืนยันตัวตนหลายปัจจัย (Multi-Factor Authentication – MFA) ที่ผสมผสานวิธีการต่างๆ เข้าด้วยกัน เช่น รหัสผ่าน, รหัส OTP, การสแกนลายนิ้วมือ หรือการจดจำใบหน้า จะกลายเป็นมาตรฐานที่จำเป็น นอกจากนี้ การสร้างความตระหนักรู้และให้ความรู้แก่ประชาชนและพนักงานให้เข้าใจถึงภัยคุกคามรูปแบบใหม่นี้ ถือเป็นส่วนสำคัญในการสร้างแนวป้องกันตั้งแต่ต้นทาง เพื่อลดโอกาสการตกเป็นเหยื่อ

วิธีสังเกตและป้องกันตัวจากแก๊งคอลเซ็นเตอร์ AI

แม้ว่าเทคโนโลยี AI Deepfake จะทำให้การหลอกลวงมีความแนบเนียนขึ้น แต่ก็ยังคงมีช่องโหว่และสัญญาณเตือนที่สามารถสังเกตได้ การมีสติ รอบคอบ และปฏิบัติตามหลักการ “ไม่เชื่อ ไม่รีบ ไม่โอน” ยังคงเป็นเกราะป้องกันที่ดีที่สุด การเรียนรู้เทคนิคการสังเกตและขั้นตอนการรับมือที่ถูกต้องจะช่วยลดความเสี่ยงจากการตกเป็นเหยื่อได้อย่างมีนัยสำคัญ

| สัญญาณเตือนที่ต้องระวัง | วิธีป้องกันและรับมือ |

|---|---|

| การสร้างสถานการณ์เร่งด่วน | ตั้งสติ อย่าตื่นตระหนก และไม่ตัดสินใจโอนเงินหรือให้ข้อมูลทันที ขอเวลาในการตรวจสอบข้อเท็จจริงก่อนเสมอ |

| โทรจากเบอร์โทรศัพท์ที่ไม่คุ้นเคย | หากมีบุคคลที่อ้างว่าเป็นคนรู้จักโทรมาจากเบอร์แปลก ให้วางสายแล้วโทรกลับไปยังเบอร์โทรศัพท์ของบุคคลนั้นที่บันทึกไว้โดยตรง |

| ขอข้อมูลส่วนตัวหรือข้อมูลทางการเงิน | ห้ามให้ข้อมูลที่ละเอียดอ่อน เช่น เลขบัตรประชาชน, รหัสผ่าน, หรือเลขบัตรเครดิต ผ่านทางโทรศัพท์โดยเด็ดขาด |

| น้ำเสียงหรือการใช้คำพูดที่ผิดปกติ | สังเกตจังหวะการพูดที่ขาดตอน, การตอบสนองที่ช้าผิดปกติ, หรือการใช้คำศัพท์ที่ไม่เป็นธรรมชาติของคนๆ นั้น |

| ปฏิเสธการยืนยันตัวตนผ่านช่องทางอื่น | หากผู้โทรบ่ายเบี่ยงที่จะสนทนาผ่านวิดีโอคอล หรือปฏิเสธการติดต่อกลับผ่านช่องทางอื่น ให้สันนิษฐานว่าเป็นมิจฉาชีพ |

เทคนิคการสังเกตความผิดปกติระหว่างสนทนา

นอกเหนือจากสัญญาณเตือนในตารางแล้ว ยังมีเทคนิคเชิงลึกที่สามารถใช้เพื่อจับผิดเสียงปลอมได้ แม้ว่า AI จะมีความสามารถสูง แต่ก็ยังมีข้อจำกัดบางประการ:

- การตั้งคำถามที่ไม่คาดคิด: ลองถามคำถามที่เป็นเรื่องส่วนตัวมากๆ หรือเกี่ยวกับความทรงจำร่วมกันที่เฉพาะเจาะจงซึ่งมีเพียงบุคคลนั้นจริงๆ ที่จะตอบได้ เช่น “จำร้านอาหารที่เราไปฉลองวันเกิดปีที่แล้วได้ไหม” AI ที่ไม่ได้รับข้อมูลส่วนนี้จะไม่สามารถตอบได้อย่างถูกต้อง

- ฟังเสียงบรรยากาศรอบข้าง: เสียง Deepfake มักจะถูกสร้างขึ้นในสภาพแวดล้อมที่เงียบสนิท หรืออาจมีเสียงรบกวนที่ฟังดูผิดธรรมชาติและซ้ำๆ หากไม่ได้ยินเสียงบรรยากาศรอบข้างที่ควรจะเป็น (เช่น เสียงรถยนต์ เสียงผู้คน) อาจเป็นสัญญาณที่น่าสงสัย

- สังเกตการหายใจและเสียงแทรก: เสียงที่สังเคราะห์ขึ้นอาจขาดเสียงที่เป็นธรรมชาติของมนุษย์ เช่น เสียงการถอนหายใจ การกระแอม หรือเสียงลมหายใจระหว่างประโยค ซึ่งเป็นรายละเอียดเล็กๆ น้อยๆ ที่ทำให้การสนทนาสมจริง

ขั้นตอนการรับมือเมื่อตกอยู่ในสถานการณ์ต้องสงสัย

หากรู้สึกว่าการสนทนาทางโทรศัพท์มีความน่าสงสัยและอาจเป็นกลลวงจากมิจฉาชีพ ควรปฏิบัติตามขั้นตอนต่อไปนี้อย่างเคร่งครัด:

- ควบคุมสติและวางสายทันที: อย่าลังเลที่จะตัดสายสนทนาหากรู้สึกไม่ปลอดภัย การสนทนาต่ออาจทำให้มิจฉาชีพมีโอกาสใช้จิตวิทยาในการโน้มน้าวมากขึ้น

- ตรวจสอบกับบุคคลที่ถูกอ้างถึงโดยตรง: สิ่งที่สำคัญที่สุดคือการติดต่อบุคคลที่มิจฉาชีพอ้างถึงผ่านช่องทางที่เชื่อถือได้ เช่น โทรเข้าเบอร์มือถือที่บันทึกไว้ในเครื่อง หรือติดต่อผ่านแอปพลิเคชันสนทนาที่ใช้เป็นประจำ เพื่อยืนยันว่าเรื่องราวที่ได้ยินเป็นความจริงหรือไม่

- อย่าโอนเงินโดยเด็ดขาด: ไม่ว่าจะถูกกดดันหรืออ้อนวอนเพียงใด ห้ามทำธุรกรรมทางการเงินใดๆ ทั้งสิ้นจนกว่าจะสามารถยืนยันข้อเท็จจริงได้ 100%

- แจ้งเตือนคนรอบข้าง: แบ่งปันประสบการณ์ที่พบเจอให้กับสมาชิกในครอบครัว เพื่อน และเพื่อนร่วมงาน เพื่อให้ทุกคนตระหนักถึงภัยคุกคามและกลโกงรูปแบบใหม่นี้

บทสรุป: สร้างเกราะป้องกันภัยการเงินในยุคดิจิทัล

การมาถึงของเทคโนโลยี AI Deepfake เสียงปลอมโทรลวง ดูดเงินเกลี้ยงบัญชี ได้เปลี่ยนแปลงภูมิทัศน์ของอาชญากรรมไซเบอร์ไปอย่างสิ้นเชิง ภัยคุกคามนี้ไม่ใช่เรื่องไกลตัวอีกต่อไป แต่เป็นความเสี่ยงที่ทุกคนสามารถเผชิญได้ในชีวิตประจำวัน ความสามารถในการปลอมแปลงเสียงที่แนบเนียนได้ทลายกำแพงความไว้วางใจและทำให้การสื่อสารทางโทรศัพท์มีความเสี่ยงสูงขึ้นอย่างมีนัยสำคัญ

อย่างไรก็ตาม ท่ามกลางความท้าทายนี้ เครื่องมือที่ทรงพลังที่สุดในการป้องกันตนเองคือความรู้และความรอบคอบ การตระหนักว่าภัยคุกคามรูปแบบนี้มีอยู่จริง การทำความเข้าใจกลวิธีการของมิจฉาชีพ และการยึดมั่นในหลักการตรวจสอบก่อนตัดสินใจ คือหัวใจสำคัญของการสร้างเกราะป้องกันทางการเงินที่แข็งแกร่ง การตั้งคำถามเสมอเมื่อได้รับการติดต่อที่น่าสงสัย การยืนยันข้อมูลผ่านช่องทางที่สอง และการไม่รีบร้อนทำตามคำขอที่เกี่ยวข้องกับการเงิน คือพฤติกรรมที่จำเป็นในยุคดิจิทัล การแบ่งปันข้อมูลและแจ้งเตือนคนใกล้ชิด โดยเฉพาะผู้สูงอายุหรือผู้ที่อาจตามไม่ทันเทคโนโลยี จะช่วยสร้างเครือข่ายความปลอดภัยที่เข้มแข็งและลดโอกาสที่มิจฉาชีพจะประสบความสำเร็จได้